终于把 word2vec 的思想搞清楚了!

- 2026-04-20 18:42:40

终于把 word2vec 的思想搞清楚了!

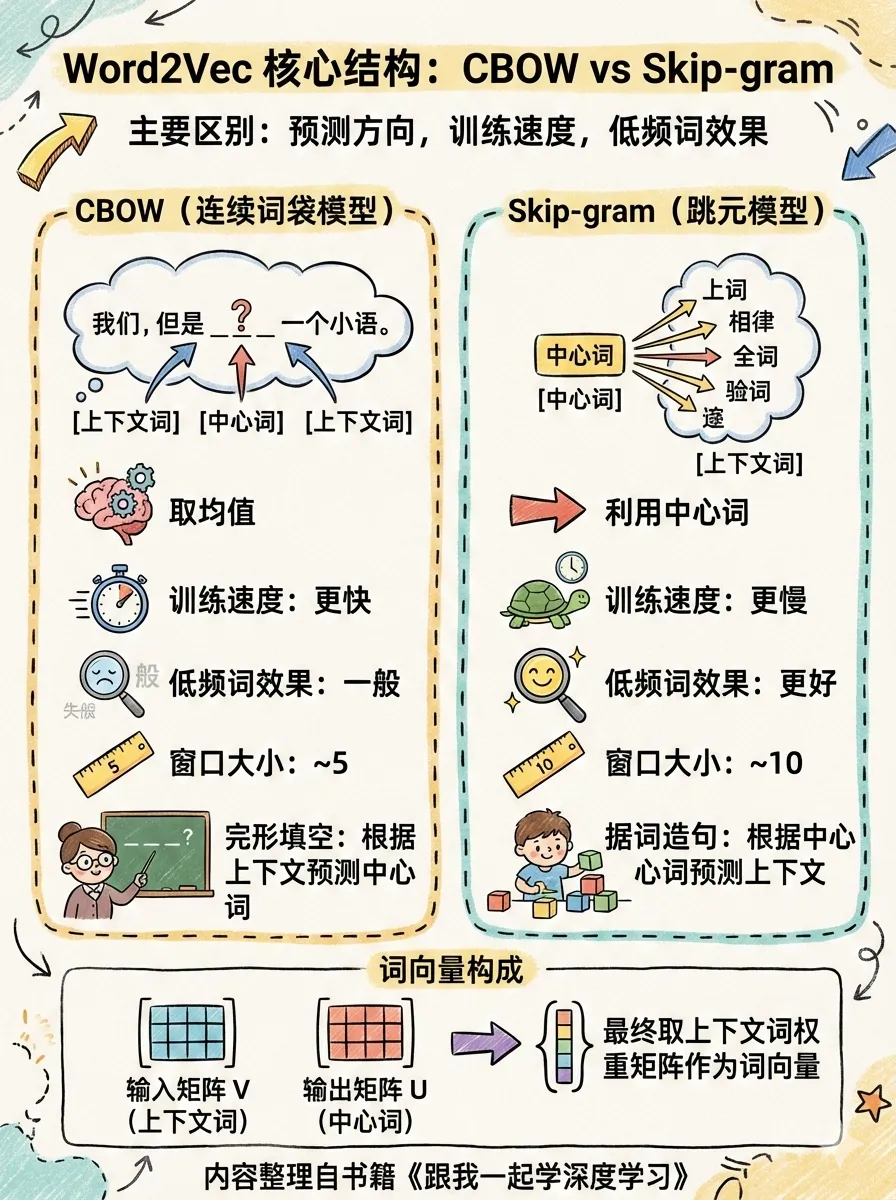

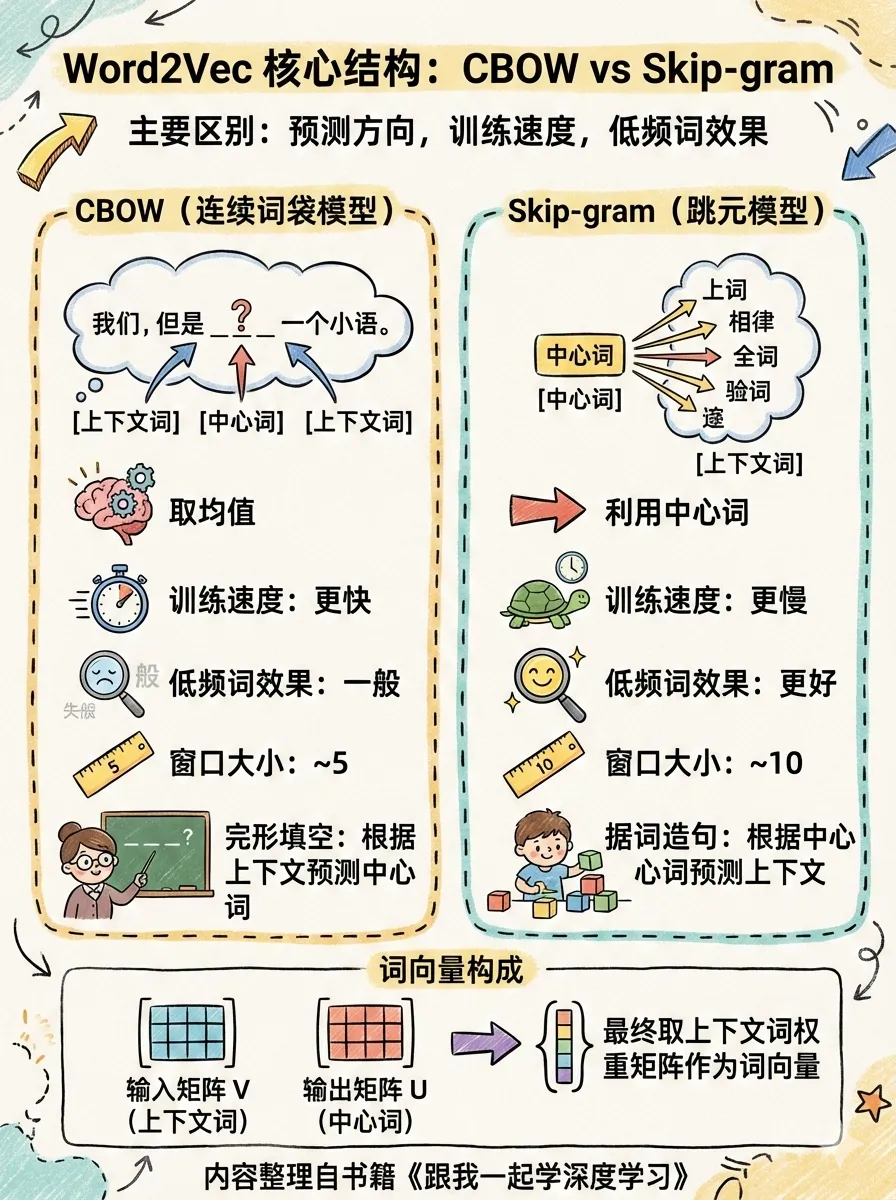

在 Word2Vec 模型中,CBOW(Continuous Bag of Words,连续词袋模型)和 Skip-gram(跳元模型)是两种核心的网络结构,它们的主要区别在于预测方向、训练速度以及对低频词的处理效果。

<<< 左右滑动见更多 >>>

1. 预测机制(核心区别)

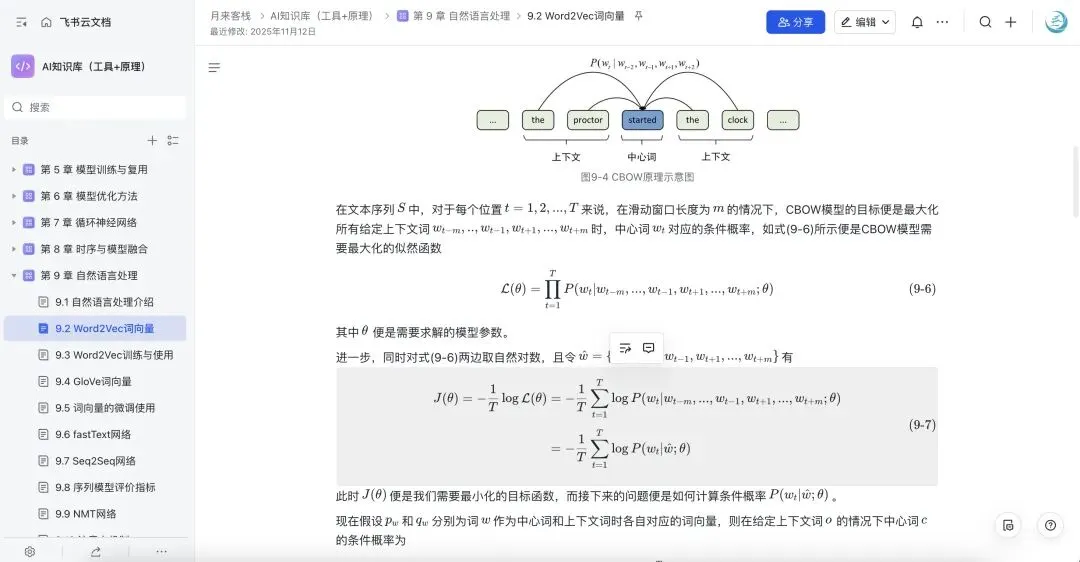

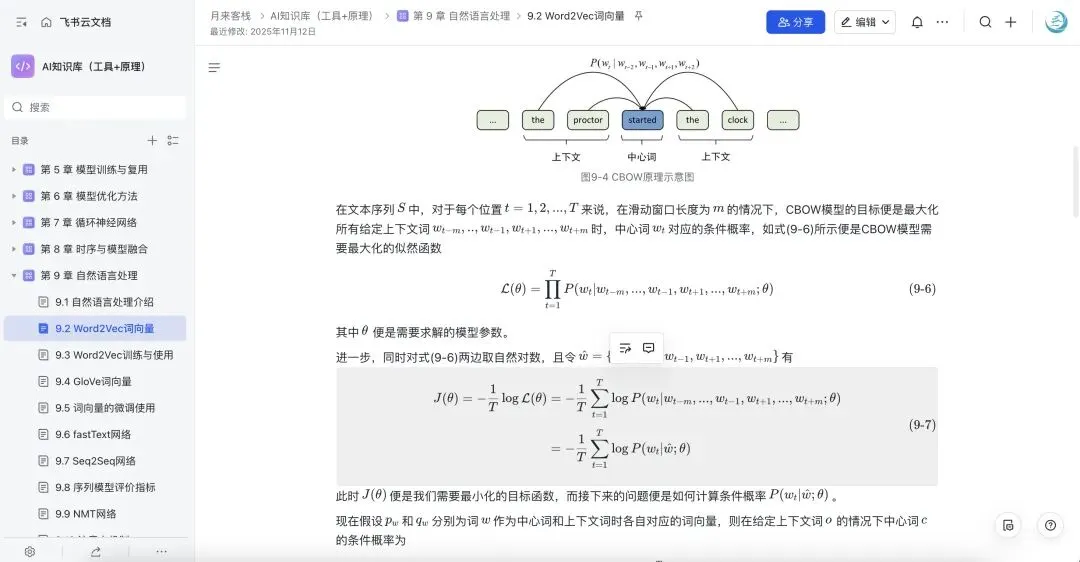

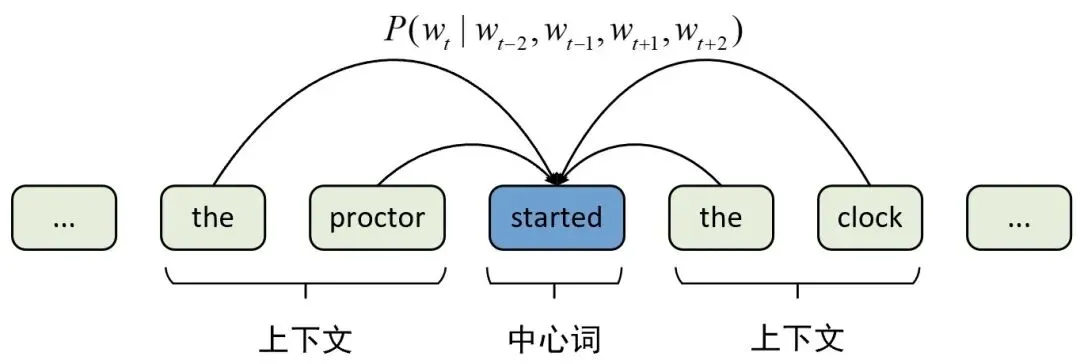

CBOW 的核心思想是在固定滑动窗口内,根据上下文词来预测中心词。它会将窗口内所有上下文词对应的词向量取均值,作为输入来预测中心词的概率分布。

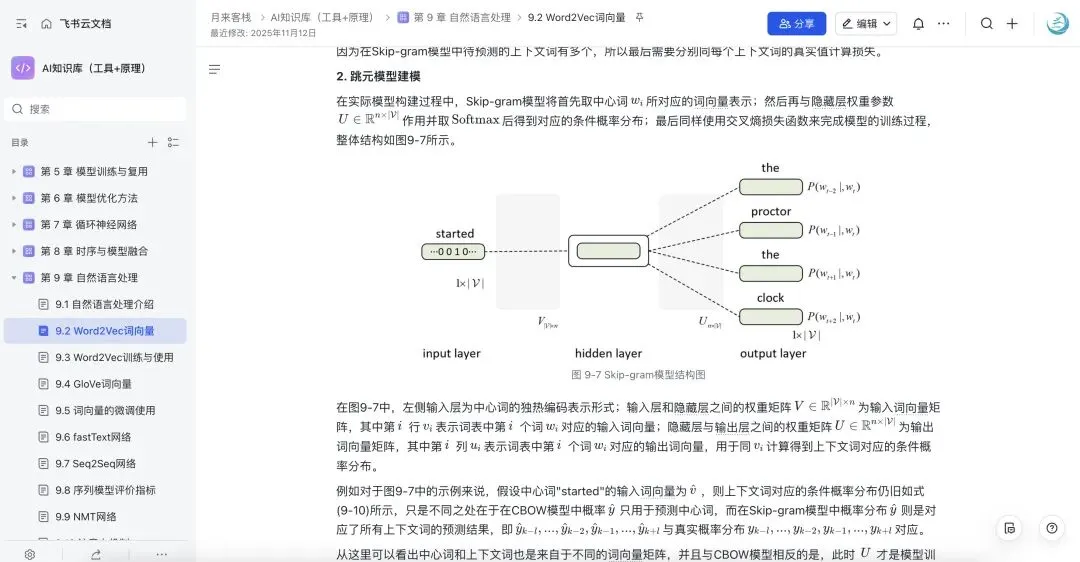

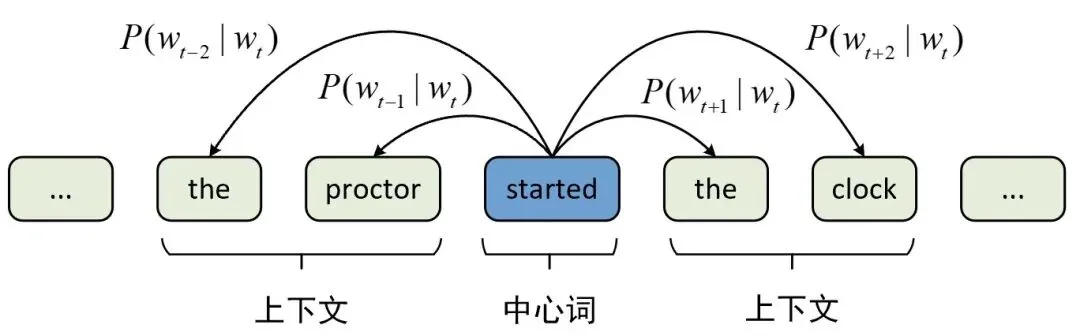

Skip-gram 的核心思想则刚好相反,它是根据中心词来预测其上下文各个词。它利用中心词的向量表示,去最大化滑动窗口中所有上下文词出现的条件概率。

2. 训练效率与性能

训练速度:CBOW 通常比 Skip-gram 训练速度更快。

低频词效果:Skip-gram 在处理低频词(不经常出现的词)时表现更好,能够捕捉更丰富的语义关系。

滑动窗口大小:在实际应用中,CBOW 的窗口大小通常设置在 5 左右,而 Skip-gram 的窗口大小通常设置在 10 左右。

词向量的构成:

在这两种模型中,上下文词和中心词通常分别来自不同的权重矩阵(输入矩阵 和输出矩阵 )。最终,通常取上下文词对应的权重矩阵作为训练完成后的词向量表示。

3 总结

CBOW 就像是一道“完形填空”题:老师把句子中间的一个词挖掉,让你根据前后的词推测中间填什么。 Skip-gram 就像是“据词造句”:老师给你一个词,让你想象它在不同的句子里周围可能会出现哪些词。

大厂算法工程师|写作八年累计数百万字出版《跟我一起学机器学习》|《跟我一起学深度学习》|《一本書晉升深度學習世界級大師》,深谙AI算法入门之道!订阅知识库两个月带你轻松弄懂机器学习

往期精选推荐

[1] 10大经典机器学习算法分类与总结

[2] 卷积神经网络中池化层的主要作用是什么?

[3] 在卷积神经网络中,什么是“可视野”?

[4] 深度学习反向传播的本质是什么?

[5] Kmeans聚类最小化簇内距离是什么意思?

[6] 反向传播和梯度下降有什么区别?

[7] 为什么RBF核函数能将特征映射到无穷维?

点击下图购买作者编著新书

本文来自网友投稿或网络内容,如有侵犯您的权益请联系我们删除,联系邮箱:wyl860211@qq.com 。