GTC 2026 主题演讲现场 | 图源:NVIDIA

"This is how intelligence is made. A new kind of factory, generator of tokens, the building blocks of AI."

Token,AI的砖块。工厂,Token的生产者。老黄,真正的庄家。

三个小时的GTC 2026主题演讲结束后,所有人都在讨论同一个话题:黄仁勋用一张PPT,重新定义了AI时代的商业逻辑。

而这张PPT的核心,不是任何一颗芯片的名字,而是一个概念——Token Factory。

📈 百万倍:推理拐点为什么是一切的起点

在亮出任何一颗芯片之前,老黄先亮出了一个数字:

"Computing demand has increased by 1 million times in the last two years."

过去两年,AI算力需求涨了100万倍。

这不是PPT上的目标数字,这是老黄站在台上感受到的实实在在的需求压力。OpenAI想要更多算力,Anthropic想要更多算力,每个AI公司都在喊算力不够。

飞轮已经转起来了。

为什么是"推理拐点"?

因为之前所有的算力暴涨,都来自训练——造模型。你只需要训练一次,但要用一万次。

而现在,拐点出现了:推理正在成为主战场。每个用户、每次对话、每个Agent任务,都在消耗Token。

老黄给出了推导过程:

- 每个推理任务所需的算力:增长 10,000倍(模型越来越大,思考越来越深)

- 推理请求的数量:增长 100倍(从简单问答到复杂任务)

两者相乘 = 100万倍

这就是推理拐点的本质:不是AI变强了一点,是"用AI"这件事本身变成了主战场。

而推理消耗的是Token。所以Token需求的天花板,根本不是"有多少公司用AI",而是"有多少任务值得交给AI"。这个天花板,还在持续往上抬。

🎰 那张"所有CEO都会研究"的PPT

Token工厂定价坐标图 | 图源:NVIDIA

老黄展示了一张坐标图。纵轴是Token吞吐量(每瓦产出多少Token),横轴是Token生成速度(每个用户每秒拿到多少Token)。

然后他说了一句把在场所有CEO都钉在椅子上的话:

"Every CEO in the world will study their business in the way I'm about to describe. Because this is your token factory. This your revenues."

(全世界的CEO都会用我接下来讲的方式来研究自己的业务。因为这就是你的Token工厂,这就是你的营收。)

吞吐量和速度,两个不能同时满足的目标

这是理解这张PPT最关键的一句话——也是最容易被忽略的一句话。

老黄画了两个方向:横轴越靠右,速度越快,AI越"聪明";纵轴越高,吞吐量越大,单位电力的Token产出越高。

但聪明和高效,是一对天敌。

模型越大,处理越复杂,Token生成的速度就越慢——就像一个人越深度思考,回答得就越慢。你要它快,就不能让它想太多。

"The smarter the AI, the lower your throughput. Makes sense? You're thinking longer."

(AI越聪明,吞吐量越低。理解吗?因为你想得更久。)

这就是推理系统的核心矛盾:吞吐量和延迟,是一对冤家。 优化了速度,就牺牲了效率;优化了效率,就牺牲了响应体验。

而老黄的解法是——分层。让不同芯片专门负责不同象限。 Vera Rubin负责高吞吐高智能,Groq LPU负责低延迟极速推理。物理上分开,但用户体验上无缝。

Token的五层定价:commodity的新分法

在这张图上,老黄画出了五层定价:

老黄算了一笔账:假设一个研究团队每天消耗5000万Token,用旗舰层$150算——

"As it turns out, as a research team, that's not even a thing."

(对一个研究团队来说,这根本不算什么事。)

这句话的言外之意:Token的天花板还远远没到。

更重要的是,老黄给了一个框架级的定义:

Token是新的商品。 就像电力、钢铁、石油——商品成熟之后,就会分层。有人买工业电,有人买居民电;有人买原油,有人买航空燃油。Token也是一样。

而老黄的野心是:让每一家企业,从今天开始,用Token Factory的逻辑来规划自己的AI战略。

你的营收 = 你的功率 × Token产出效率。你能优化的,是乘号后面的数字。英伟达帮你优化的,是整个算式的上限。

Token是大宗商品吗?这个问题比看起来更复杂

"Token是大宗商品"——这话听起来很顺,但稍微想深一点,就会发现一个有意思的矛盾。

大宗商品的核心特征是什么? 可标准化、可替代、在多个供应商之间自由流通,买家只关心价格和纯度,不关心是谁生产的。

但Token不是。GPT-5的Token和Llama的Token,能一样吗?Claude Code帮你写代码的Token,和Perplexity给你搜答案的Token,是同一个东西吗?

Token本质上是"智慧密度"不同的产物。 越聪明的模型,用越贵的芯片,消耗越多电力——它的Token定价自然越高。

那老黄为什么还要说"Token是大宗商品"?

因为他在卖的是定义大宗商品的工具。

商品经济的前提是:有市场、有定价、有交易。而建立这一切的前提是:有标准、有测量、有基准。英伟达正在做的是——成为Token的OPEC+标准制定者。

你的Token工厂产出的Token,英伟达帮你测量(tokens per watt)、帮你定价(分层定价模型)、帮你优化(TensorRT、Dynamo、极致代码设计)。

这不是在卖商品,这是在卖商品的标准。

⚡ 为什么"免费也不便宜"

图源:NVIDIA

老黄说了一句比任何芯片参数都狠的话:

"If you have the wrong architecture, even if it's free, it's not cheap enough."

(如果架构选错了,即使芯片免费送你,你也用不起。)

这不是在说英伟达的芯片贵。这是在说:架构选择才是真正的成本中心。

他的推导:一座1GW的数据中心,15年摊销下来——地皮+电力+冷却+建筑+维护——至少400亿美元。这笔钱,不管你往里面塞什么芯片,都要花。

真正的成本,不在芯片上,在那座工厂里。

而你的Token产出效率,决定了你能不能覆盖那400亿。芯片选对了,每天都在帮你省钱;芯片选错了,每天都在烧钱。

所以Semi Analysis的独立评测一出,老黄就笑了。

Dylan Patel测出来的结论是:Grace Blackwell的推理效率比老黄自己说的35倍还高,实测是50倍。

"He accused me of sandbagging. And he's not wrong."

(他指责我故意压低数字。他没错。)

50倍,不是35倍。这个误差本身就是一个信息:英伟达不只在卖芯片,他们在卖算法。

分析师Dylan Patel干脆给他起了个封号——Semi Analysis将黄仁勋封为"Token King"(Token之王)。

同一个工厂,7倍收入

老黄还请上了一家叫Fireworks的推理服务商。用他们的案例做了一道数学题:

一年内增长100倍。 他们是Token工厂的典型客户。

用的是同一套硬件,同一座数据中心,同等的电力预算。

区别是:英伟达更新了算法和软件栈。不需要客户买新机器,收入能力直接涨7倍。

这就是"Token King"真正可怕的地方:他不只卖芯片,他卖的是让芯片产出更多Token的方法。芯片免费,方法不免费。

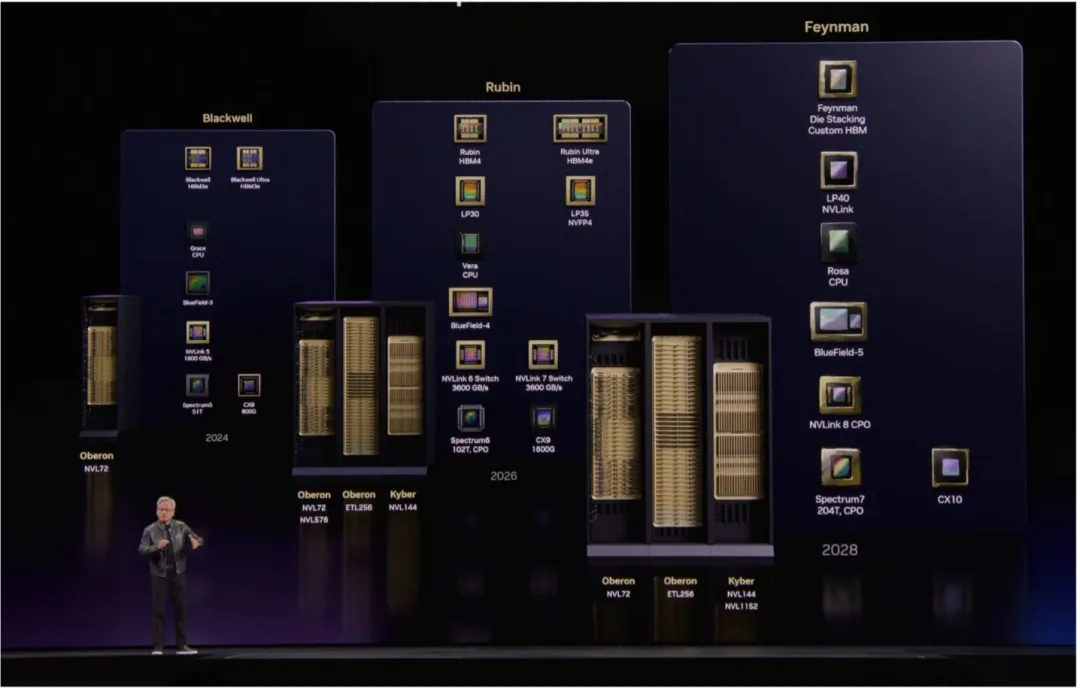

🧬 七芯合体的真正逻辑:不是炫技,是算账

Vera Rubin | 图源:NVIDIA

理解了Token经济学,Vera Rubin那张七颗芯片的表就不再是一堆参数了——每一颗芯片都在回答同一个问题:怎么在固定功率下多产Token?

- Rubin GPU——主力生产线。台积电3nm,288GB HBM4。负责理解你的问题(预填充)和高吞吐批量推理。

- Groq 3 LPU——加速车间。500MB片上SRAM,确定性数据流架构,只干一件事:以最快速度吐出Token。

两颗处理器通过以太网紧密耦合,延迟砍半。老黄说:在最有价值的推理层级,吞吐量提升35倍。

这就是Vera Rubin的"分离式推理"架构——预填充交给GPU,解码交给LPU,各干各的,最高效。

为什么是25%?

大多数场景下,预填充(理解问题)比解码(吐答案)要吃更多算力。解码只是"最后一公里",但这一公里直接决定用户体验。

其余五颗芯片——Vera CPU、NVLink 6交换机、ConnectX-9超级网卡、BlueField-4 DPU、Spectrum-X CPO光交换机——全部自研。

从芯片到网卡到交换机到存储到散热。英伟达已经不是在卖芯片了,它在卖整座工厂的设备。

最终的数字:同一座1GW数据中心,从Grace Blackwell升级到Vera Rubin + Groq,Token生成速率从每秒200万到每秒7亿。两年。350倍。

🦞 OpenClaw:一只龙虾引发的操作系统革命

OpenClaw - Agent操作系统 | 图源:NVIDIA

GTC 2026最被低估的不是任何硬件,是一只龙虾。

老黄在台上讲到OpenClaw的时候,语气跟讲芯片完全不一样——少了工程师的精确,多了一种近乎敬畏的兴奋:

"Peter Steinberger is here. He wrote a piece of software called OpenClaw. And I don't know if he realized how successful it was going to be."

有多成功?24.8万GitHub Stars,超越Linux登顶GitHub历史第一。 Linux花了30年,OpenClaw用了几周。

但重点不是数字。重点是老黄接下来做的那件事——他用描述操作系统的语法来描述OpenClaw:

- 它能调度任务(cron jobs、分步执行、子Agent派发)

- 它有多模态IO(你可以对它说话、发文字、甚至挥手)

- 它能产生子进程(spawn off sub-agents)

"I've just used the same syntax that I would describe an operating system. OpenClaw has open-sourced essentially the operating system of agent computers."

他紧接着画了一条线:

- Windows

- Linux

- Kubernetes

- OpenClaw → 让每个人拥有个人AI Agent(Agent时代)

老黄在给OpenClaw加冕:这是AI时代的Windows。

60岁老爸和龙虾的故事

演讲中最打动人的不是技术参数,是老黄播放的那段社区视频。

一个60岁的父亲——不是程序员——安装了OpenClaw。他和儿子一起做精酿啤酒,把酿酒机通过蓝牙连上了OpenClaw。然后OpenClaw自动搭建了一个网站,让人们可以在线订购他们的啤酒。

这恰好证明了OpenClaw的核心设计哲学——"The AI that actually does things"(真正会做事的AI)。

它不是聊天机器人,它是执行者。你给它一个目标,它自己规划步骤、调用工具、写代码、跑脚本、读错误日志、自我修正,直到把事情办成。

NemoClaw:英伟达给龙虾穿上防弹衣

企业网络里的Agent系统,能访问敏感信息、执行代码、对外通信——任何一个CTO听到这儿都会冒冷汗。

这就是英伟达切入的时机。他们和Peter合作,把OpenClaw包了一层企业级安全壳,叫 NemoClaw。

- OpenShell运行时

- 策略引擎

- 隐私路由器

- 网络护栏

部署方式:一条命令

nvidia-nemoclaw

老黄用了一个词来形容OpenClaw的意义:

"The OpenClaw event cannot be understated. This is as big of a deal as HTML. This is as big of a deal as Linux."

OpenClaw事件的意义怎么强调都不过分。它和HTML一样重大。和Linux一样重大。

HTML催生了互联网。Linux催生了云计算。OpenClaw正在催生Agent经济。

而英伟达通过NemoClaw,悄悄卡住了这个经济体的安全入口。上游印钞机,下游收费站——这才是万亿美元叙事真正的闭环。

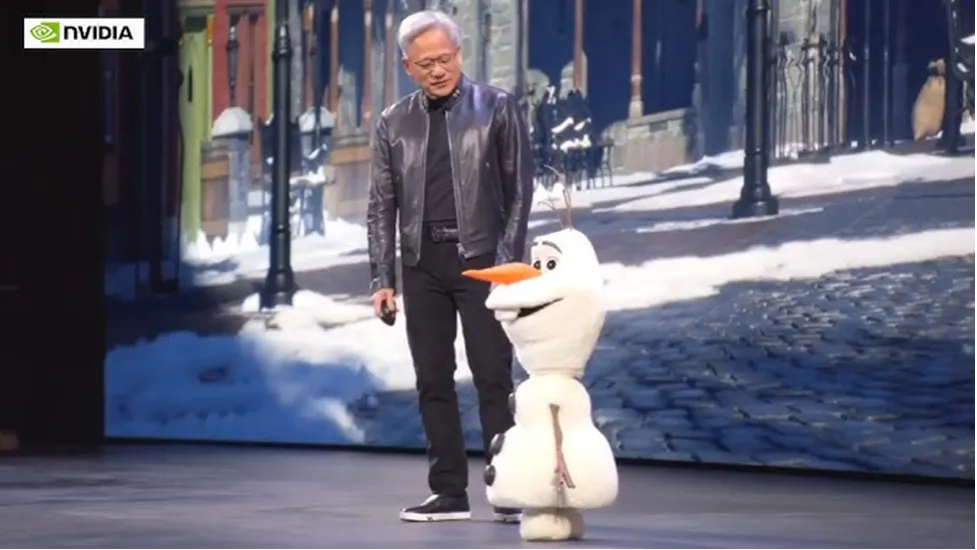

🤖 物理AI:Olaf上台那一刻

迪士尼Olaf雪人机器人 | 图源:NVIDIA

整场演讲最出乎意料的时刻,是一个迪士尼的Olaf雪人机器人走上了舞台。

它不是被遥控的。它用NVIDIA Isaac Lab训练了全身运动控制策略,用Newton物理模拟器学会了在真实世界中保持平衡和行走。

老黄跟它聊天:

Olaf回了一句:"I'm a snowman, not a snowed."(我是雪人,不是被忽悠的。)

台下笑疯了。但这个瞬间的意义远超娱乐——这是物理AI从实验室走向消费场景的标志。

老黄还宣布了与比亚迪、现代、日产、吉利的Robotaxi合作——每年1800万辆车的产能。

他说"the ChatGPT moment of self-driving cars has arrived(自动驾驶的ChatGPT时刻到了)"。

这才是"物理AI"的真正含义——不是机器人耍帅,是AI走出屏幕,进入三维世界。

💀 "SaaS已死"背后的完整逻辑

这句话在演讲后刷屏了。但大部分人只看到了结论,没看到推导过程。

第一步——计算范式变了:

"Computing used to be retrieval based, now it's generative."

(计算从检索式变成了生成式。)

第二步——AI的进化路径:

- Claude Code/Cursor(2025-2026)→ 使用工具、执行任务

"You don't ask AI what, where, when, how. You ask it: create, do, build."

(你不再问AI"什么、哪里、何时、怎么"。你让它"创造、执行、建造"。)

第三步——企业IT的重构:

以前:数据中心存文件 → 软件提供工具 → 人类操作工具

以后:Token工厂产Token → Agent消费Token → Agent执行任务

每一家SaaS公司,都将变成AaaS——Agent as a Service。

老黄甚至预测了一种全新的薪酬结构:未来每个工程师的offer里,除了基础年薪,还会有年度Token预算。

我的判断:"SaaS全部消亡"这个判断我只同意一半。SaaS的治理能力、数据安全能力、行业Know-how不会消失。但交互层一定会被Agent接管——没有人想学100个SaaS工具的操作界面,人们只想说一句话就把事办了。

不会Agent化的SaaS,确实会死。

💡 结论

看完三个小时的演讲原文字幕,我反复琢磨的不是350倍的数字,而是这整场演讲的叙事结构——

老黄在做一件事:把"卖芯片"这个故事,讲成了"卖Token"的故事。

芯片有代际更替,有竞争对手,有砍单风险。但"Token"——这个概念一旦建立,就变成了持续消费品。你不会说"我买了一颗芯片就够了",但你会说"我每天要用5000万Token"。

英伟达垂直整合了Token生产的全栈(芯片→系统→网络→散热→数字孪生),又通过NemoClaw卡住了Token消费的入口。上游印钞机,下游收费站。 这才是"万亿美元"的底层逻辑。

CUDA 20年的飞轮效应是护城河。 老黄自己说得最清楚:

"The single hardest thing to achieve is installed base. It has taken us 20 years."

(最难做到的就是装机量。我们花了20年。)

不过也要泼一盆冷水:老黄的每一个判断都在为"英伟达卖更多芯片"服务。 1万亿美元的需求、SaaS全面消亡、Token是新货币——这些叙事的终点都是同一个:你需要买更多英伟达的设备。

保持清醒。看方向,也看立场。

Token的时代确实在来。但Token的价格会不会像老黄说的那样持续高位?当竞争者出现(AMD、Intel、各种ASIC创业公司)、当开源模型效率持续提升——卖Token这门生意的利润率,不会永远这么高。

不过至少在2026年的此刻,看完那张Token定价PPT,你不得不承认——

老黄确实配得上"Token King"这个称号。

下个月去面试,记得问一句:"我的Token预算是多少?"

如果觉得有用,点个在看,让更多人看到 👇