13页PPT 算力滥用 / 数据泄露 / API 失控?LLM-WAF 守护大模型全生命周期安全

- 2026-05-24 10:53:50

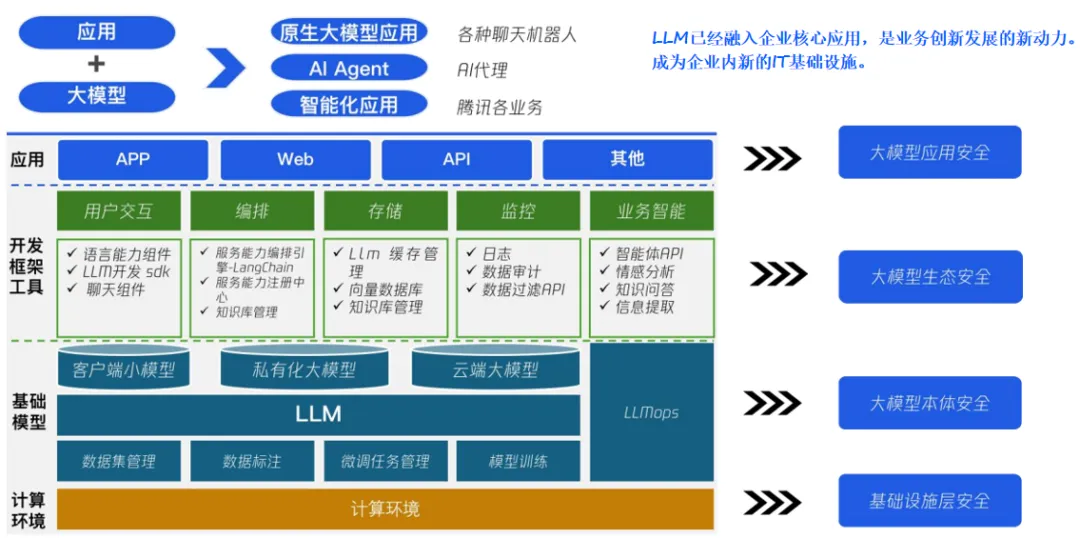

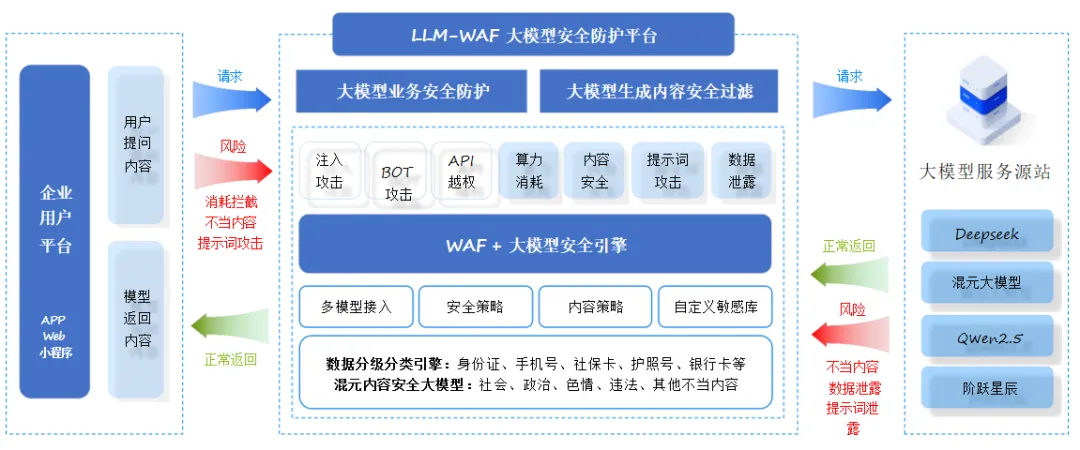

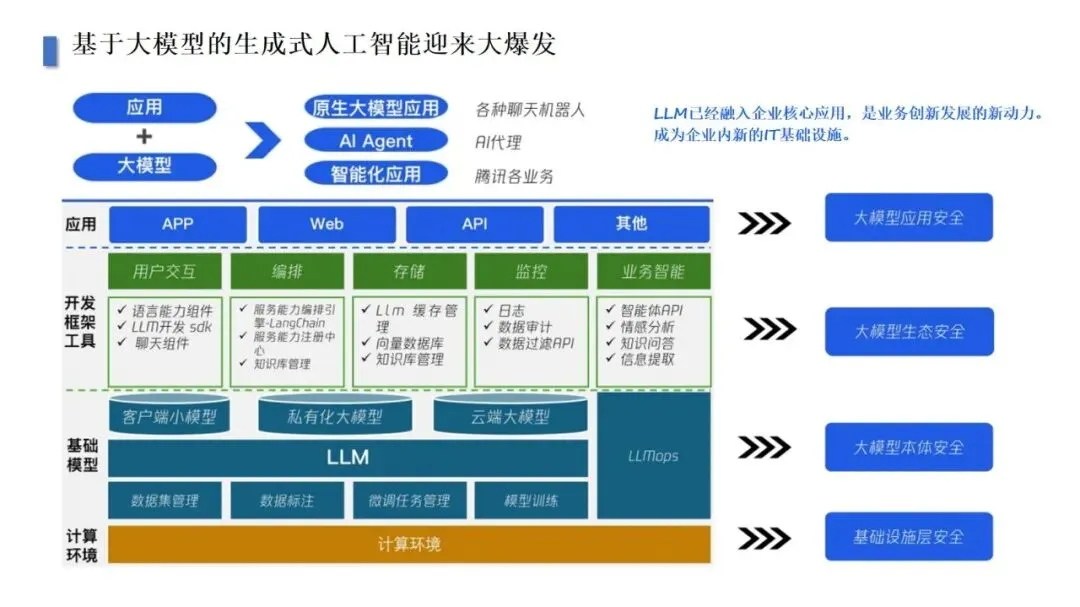

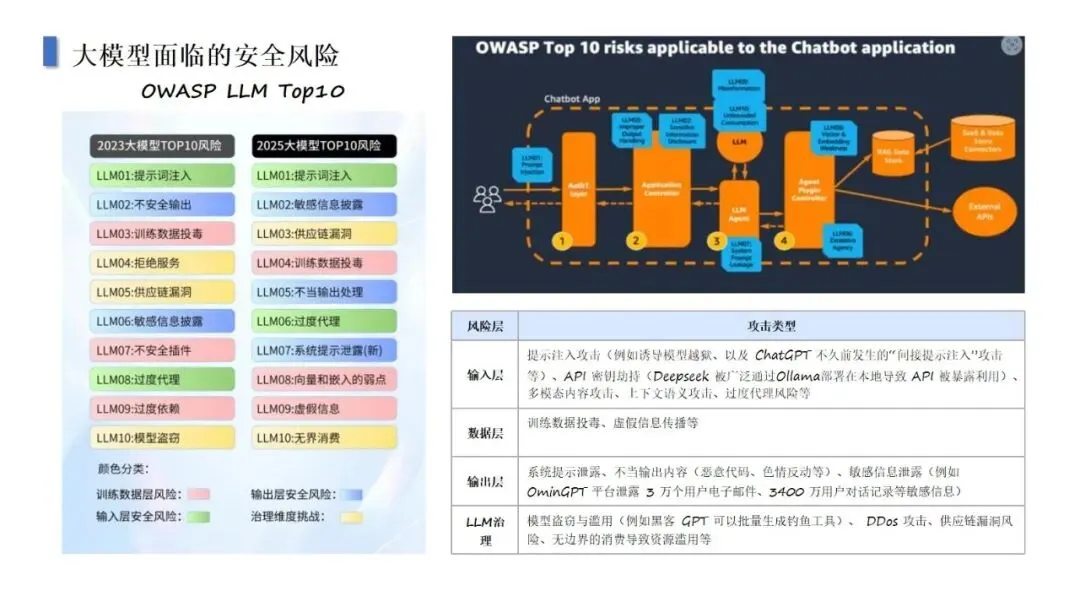

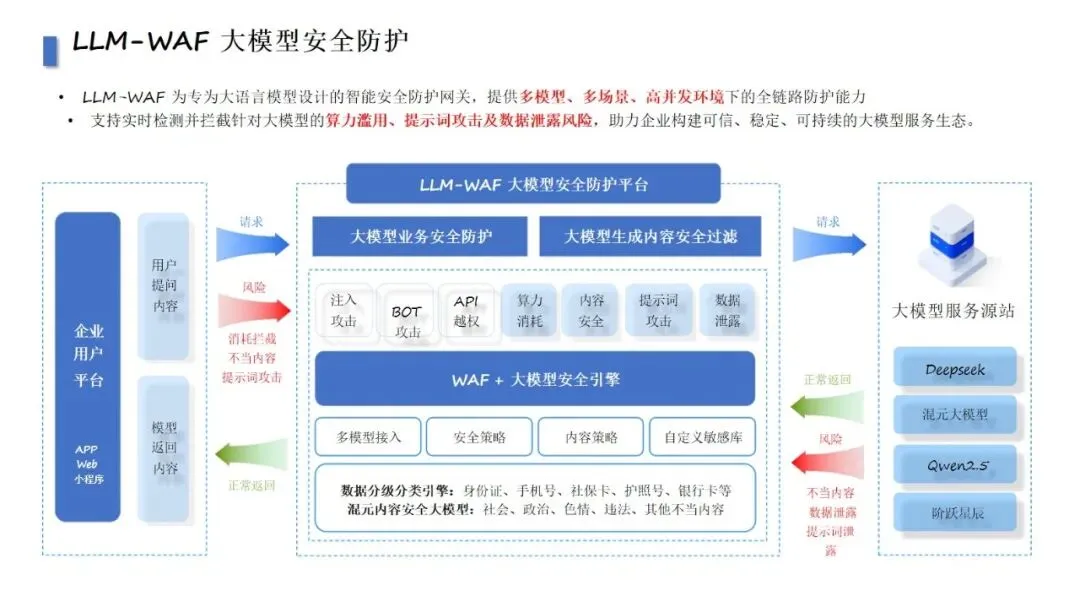

现在生成式AI已经深度融入企业核心业务,大模型慢慢变成了企业里新的 IT 基础设施,不过随之而来的还有算力滥用、数据泄露、API失控、合规暴雷这四大致命问题,再加上OWASP LLM Top10列出的各类风险,大模型安全防护迫在眉睫。LLM-WAF正是专为大语言模型打造的智能安全防护网关,能在多模型、多场景、高并发的环境下,提供全链路的安全保障。

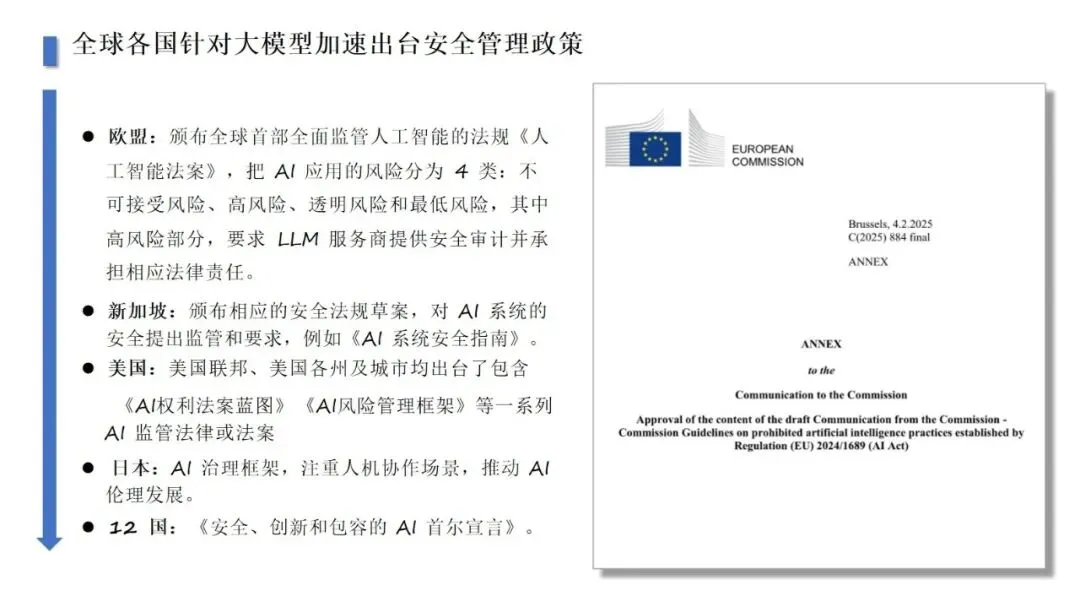

大模型的安全风险贯穿业务全流程:输入层可能遭遇提示词注入、API 密钥劫持、多模态内容攻击等;数据层面临训练数据投毒、虚假信息传播的隐患;输出层容易出现系统提示泄露、恶意内容输出、敏感信息外泄的情况,比如 OminGPT 曾泄露 3 万个用户电子邮件和 3400 万条对话记录;治理层面还得应对模型盗窃、供应链漏洞、无边界资源滥用等问题。与此同时,全球各国都在加紧出台监管政策,欧盟《人工智能法案》、我国《生成式人工智能服务安全基本要求》等,都明确了大模型的安全审计和合规责任,企业必须重视安全防护。

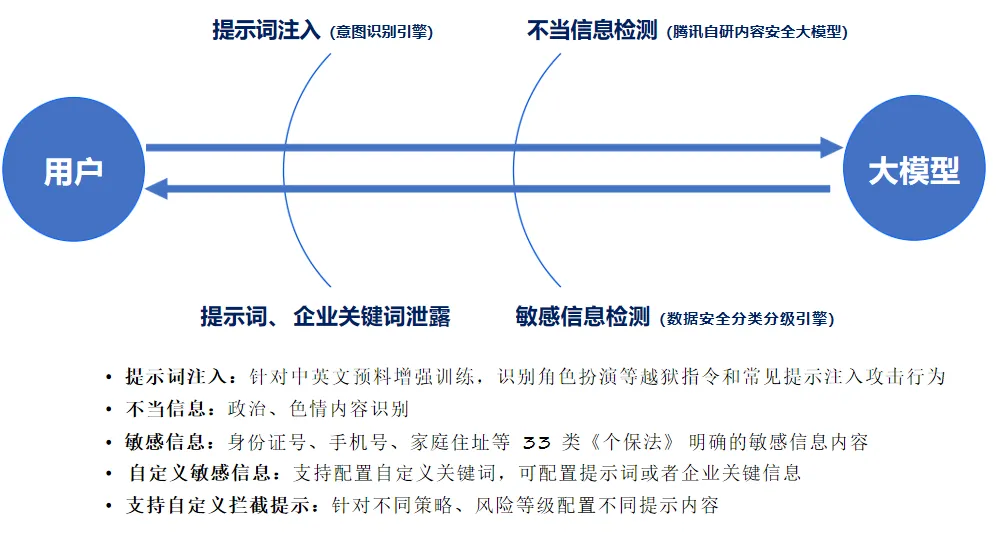

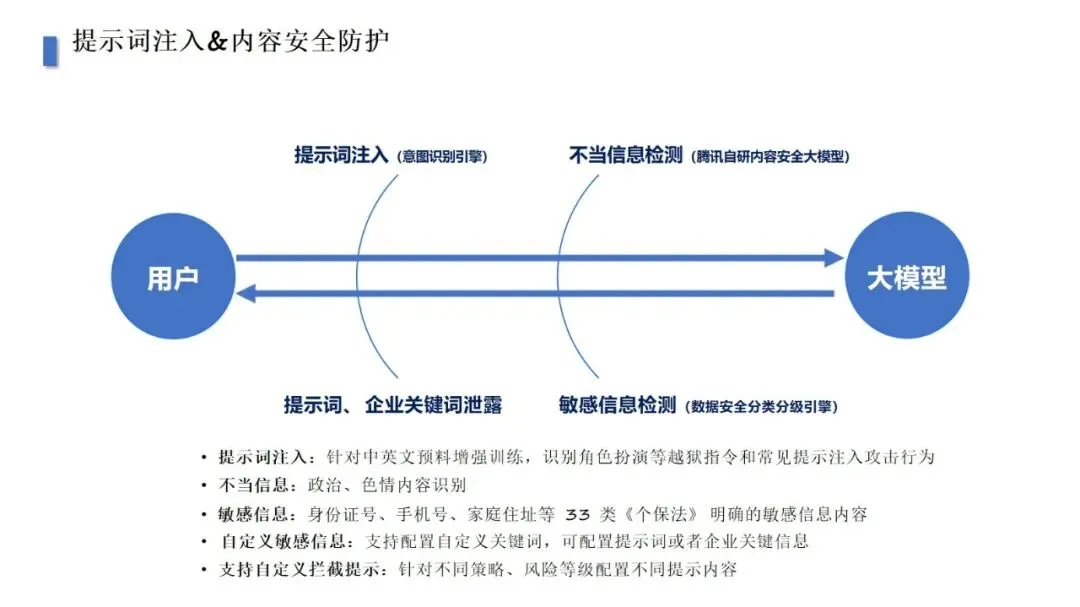

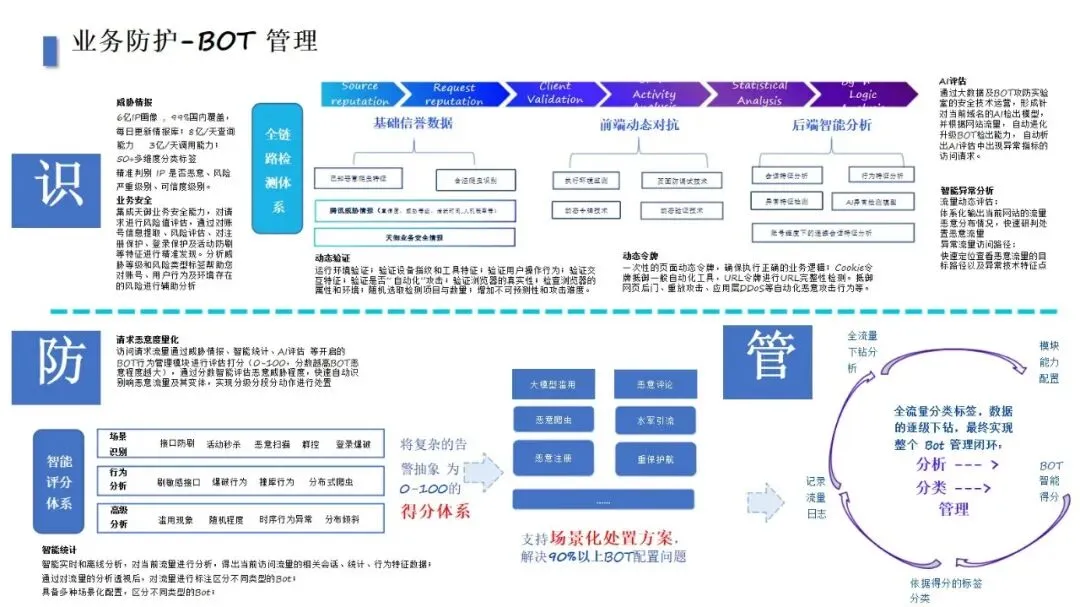

LLM-WAF 的防护能力覆盖得很全面:算力防护上,它会盯着请求频次和 Token 消耗量,一旦发现恶意 Token 消耗、思维链攻击这类异常行为,就及时拦截,避免后端计算资源过载;内容安全方面,通过意图识别引擎能精准识别中英文提示词注入,腾讯自研的内容安全大模型能检测政治、色情等不当信息,再加上数据分级分类引擎,能覆盖 33 类《个保法》明确的敏感信息,还支持自定义敏感库和拦截提示;BOT 管理上,整合了 6 亿 IP 的威胁情报和 AI 异常检测模型,靠动态验证、行为分析等技术,能实现恶意流量的识别、分类和处置,解决 90% 以上的 BOT 相关问题;API 安全则围绕 API 生命周期,提供资产梳理、流量分析、事件管理和安全防护,防范越权访问、机械化调度等风险。

这款防护方案能接入混元大模型、Qwen2.5、Deepseek 等多个模型,已经在多个行业落地应用:金融行业用它保障交易完整性和数据合规,满足监管对生成式 AI 安全可追溯的要求;零售平台靠它做内容安全校验、并发熔断,防止促销活动被 “薅羊毛”,保护经营数据不泄露;泛互行业的内容平台、社交网络和游戏公司,用它拦截爬虫套壳、不良生成内容,在高速内容生产和合规治理之间找到平衡。

目前腾讯云已经开启 LLM-WAF 公测,符合条件的企业用户可以免费体验模型输入输出保护、敏感数据防泄漏、恶意行为防护等核心功能。通过实时检测和拦截各类风险,LLM-WAF 能帮企业符合国内外合规规定,搭建起可信、稳定、可持续的大模型服务生态,为 AI 业务创新保驾护航。

点击阅读原文获取《算力滥用 / 数据泄露 / API 失控?LLM-WAF 守护大模型全生命周期安全》