46页PPT 企业落地安全大模型必看:评估框架 + 前沿实践双指南

- 2026-05-21 10:45:01

46页PPT 企业落地安全大模型必看:评估框架 + 前沿实践双指南关注公众号并星标查看更多网络安全资料

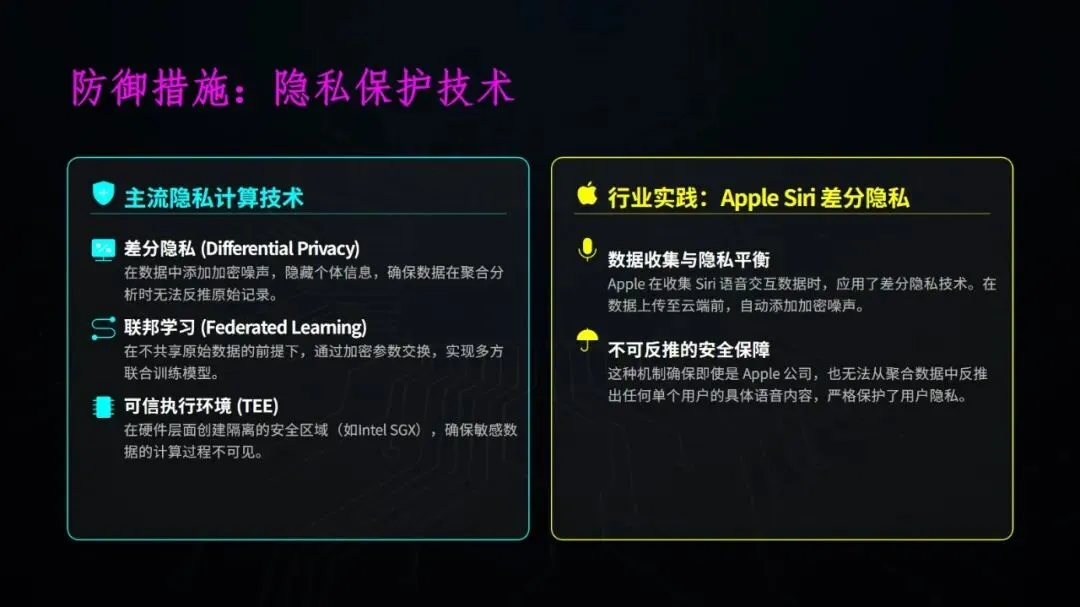

相关阅读: 49页PPT 数据安全运营体系建设指南:管理 + 监控 + 运营三维闭环构建与实践 156页 网络安全 + 数据安全双轮驱动:法规体系、关键基建防护与实践路径全景 网络安全 “3 保 1 评” 全景透视:等保 2.0 新场景、关保内网认定、密评罚款红线 全景透视《全球隐私计算报告》:从技术路径(MPC/FL/TEE)到跨境流通,行业发展关键在哪?

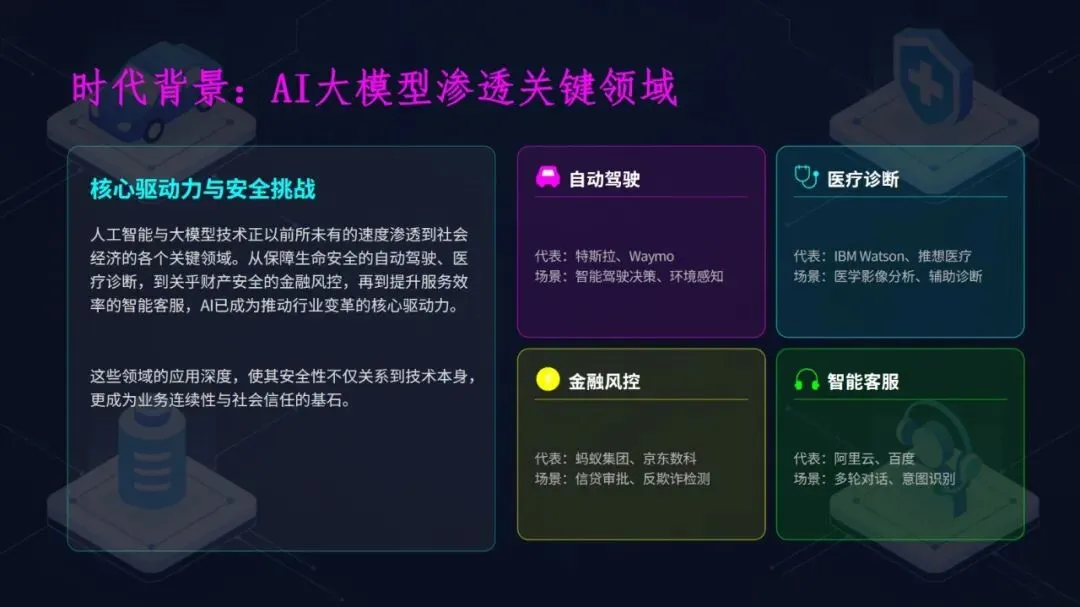

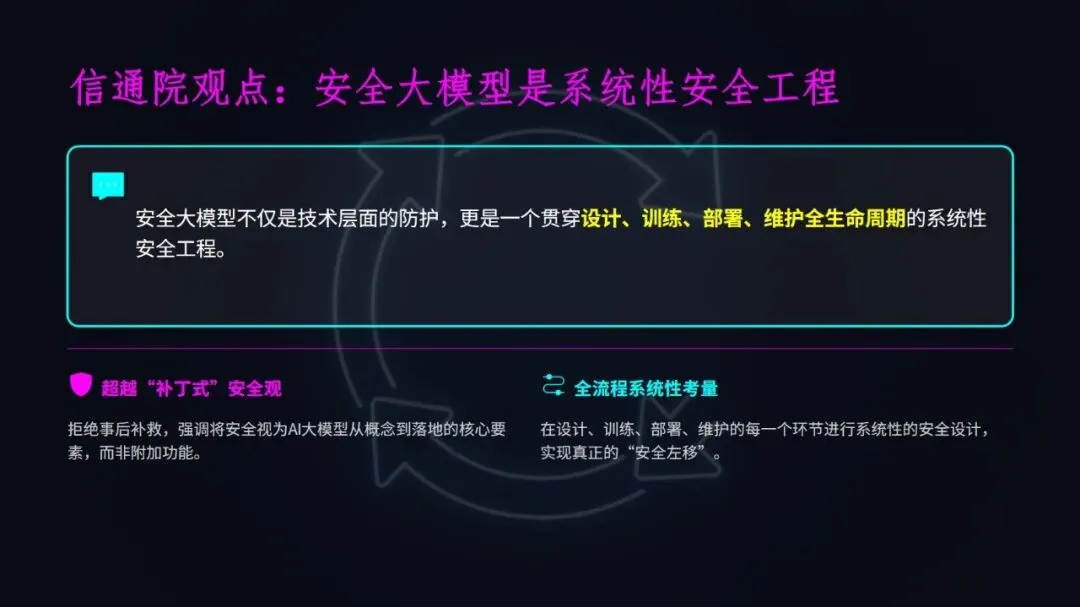

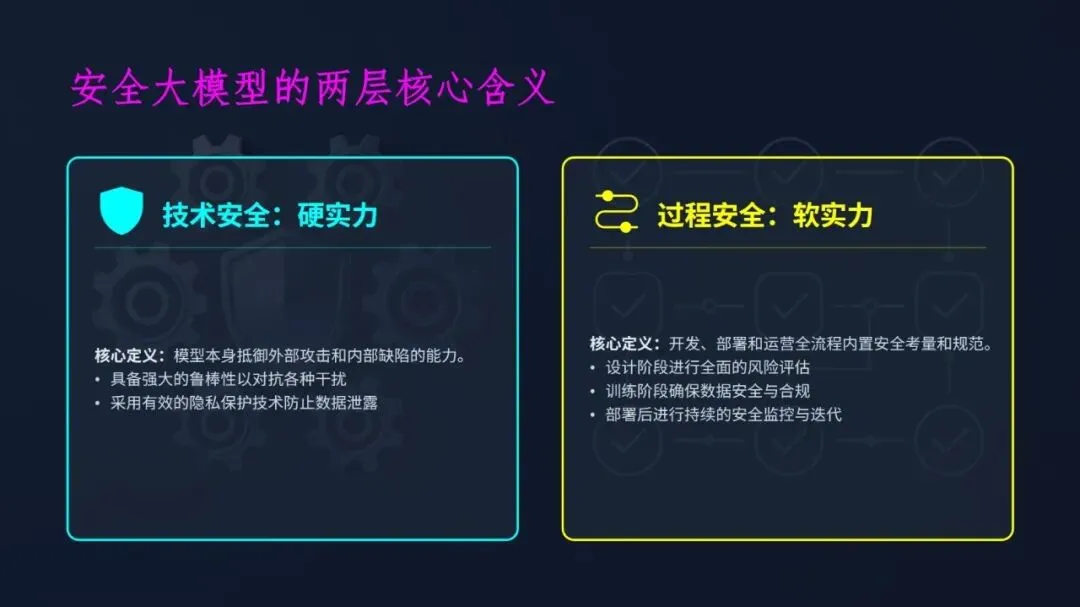

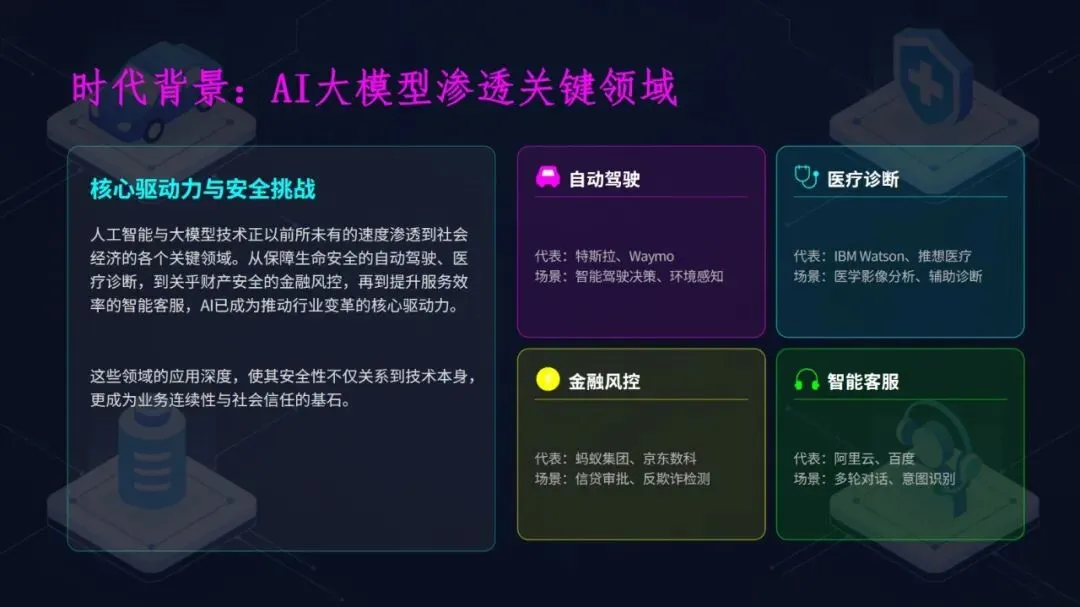

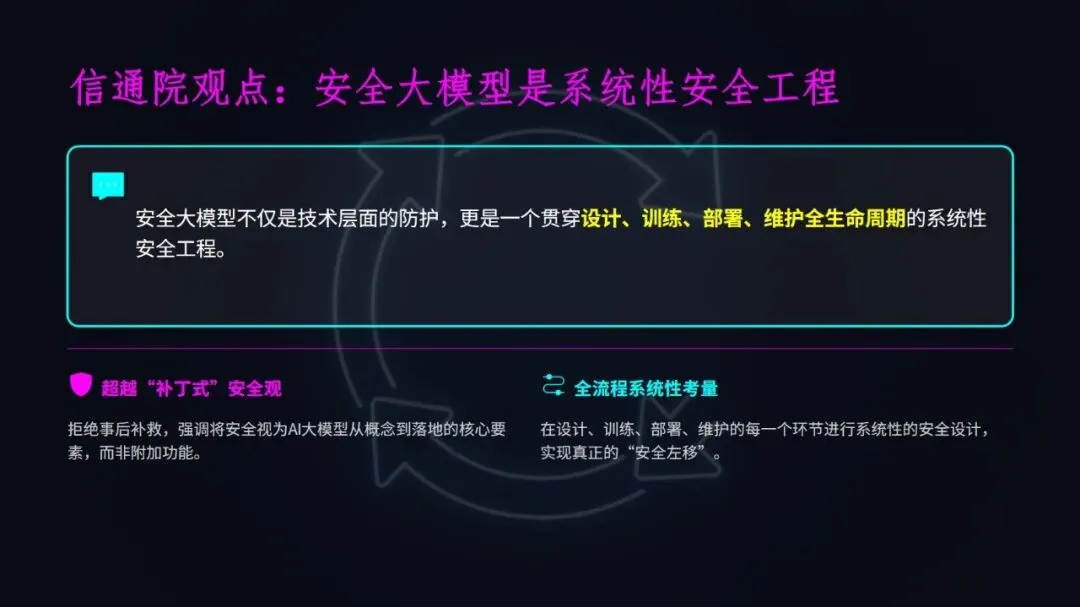

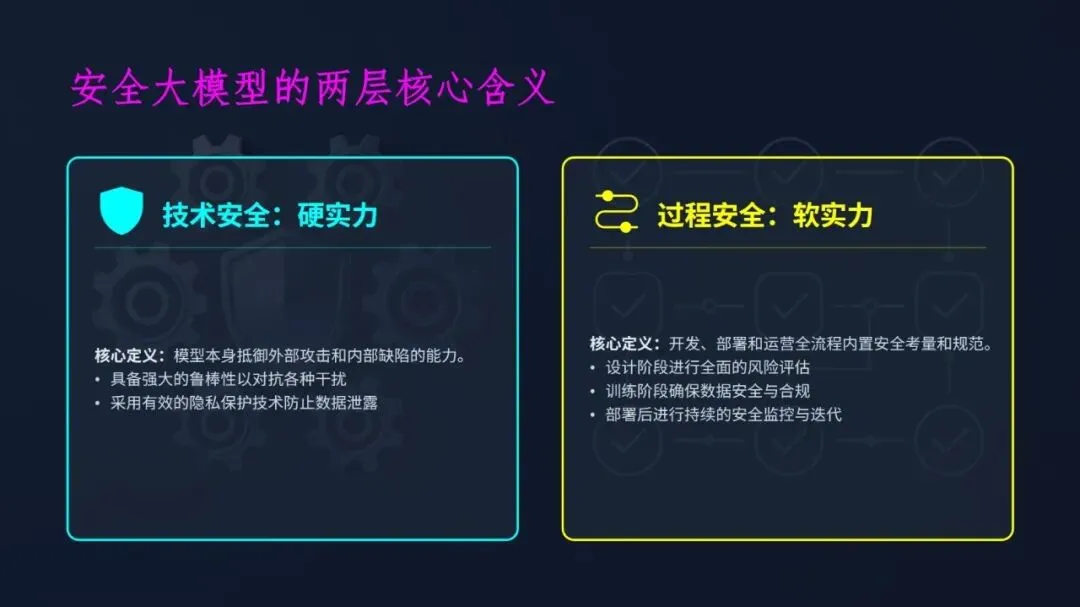

如今大模型已深度融入自动驾驶、医疗诊断等关键领域,其安全性直接关系到业务能否持续运转,更是社会信任的关键所在。紧扣行业实际需求,打造了一套覆盖大模型设计、训练、部署、维护全生命周期的安全能力要求与评估框架,为行业安全发展提供了切实可行的指引。

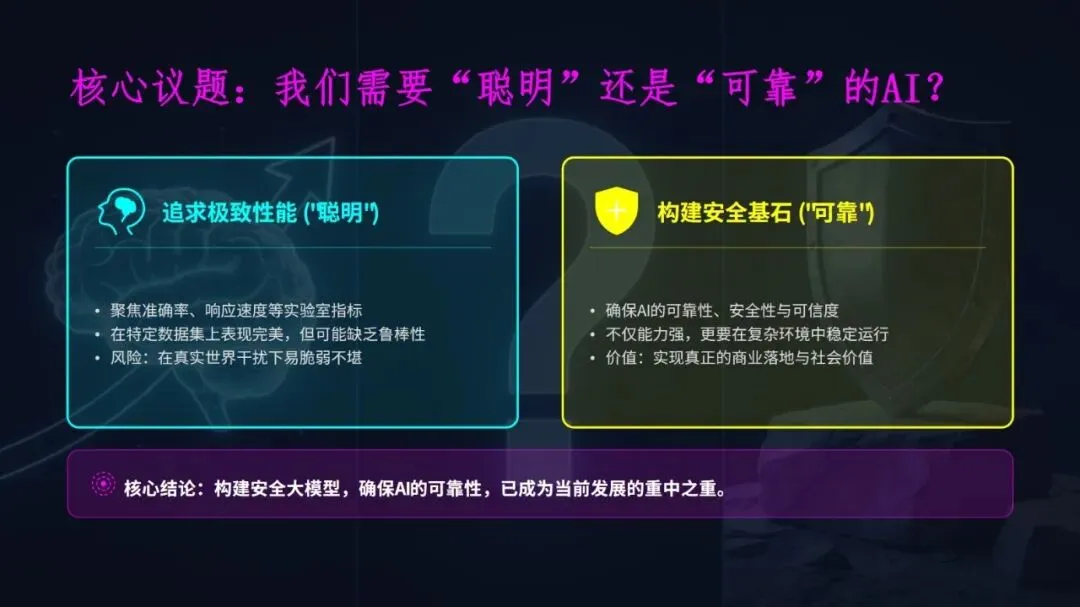

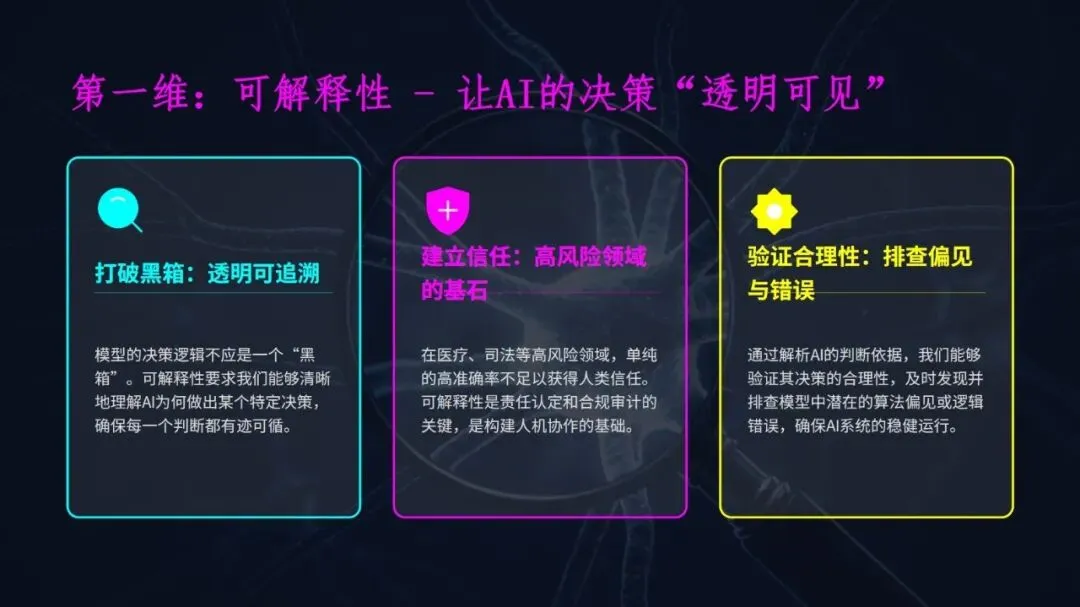

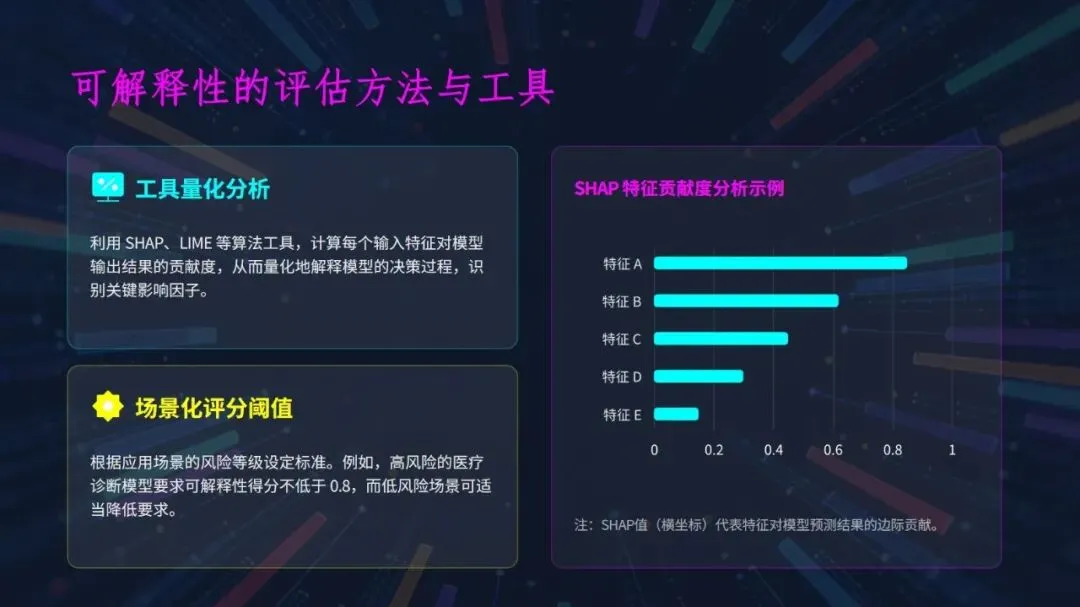

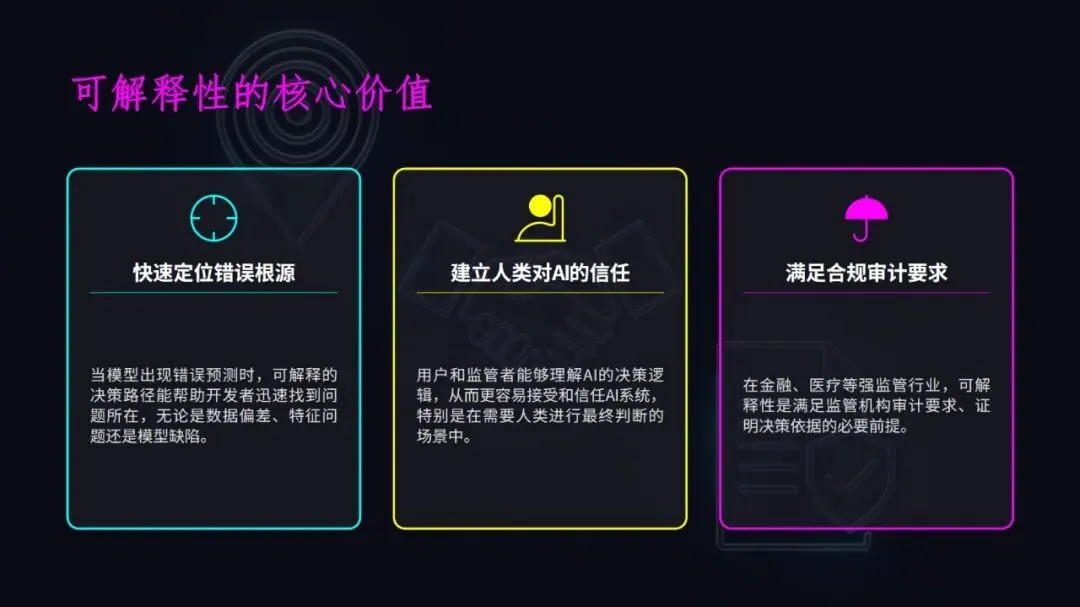

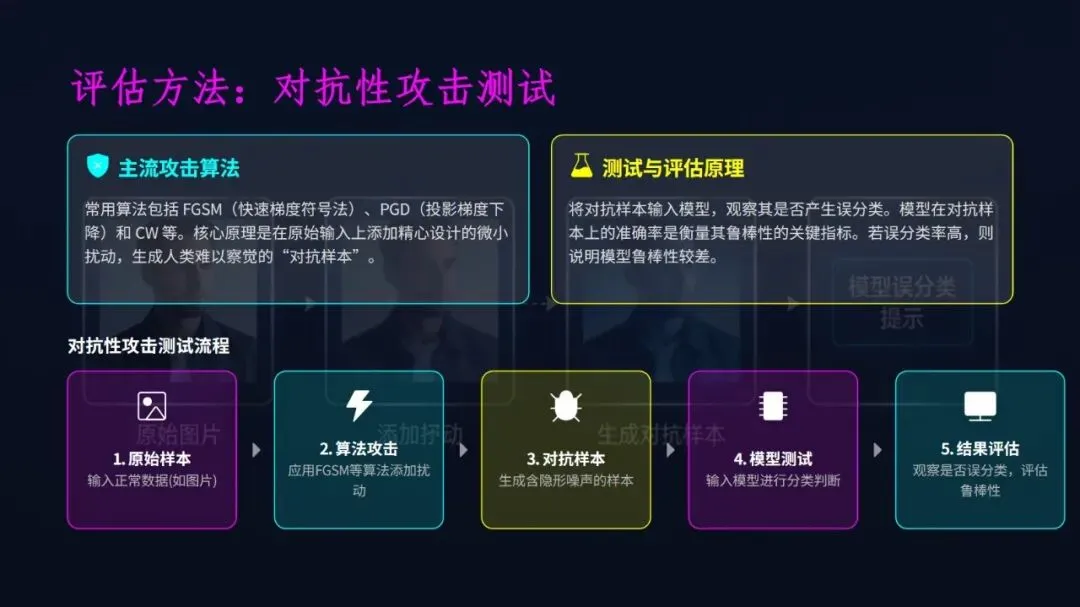

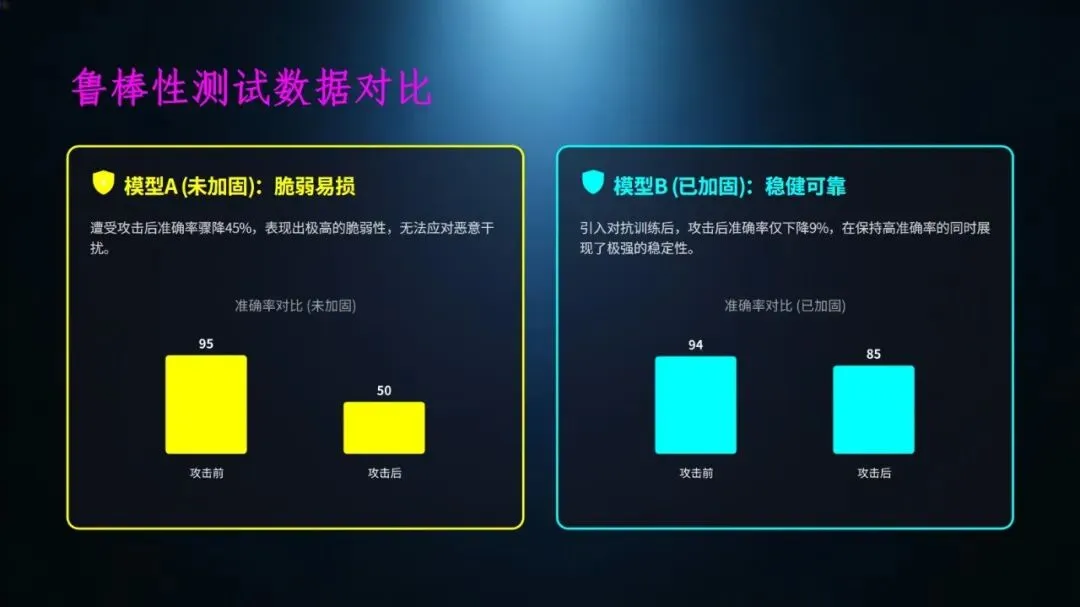

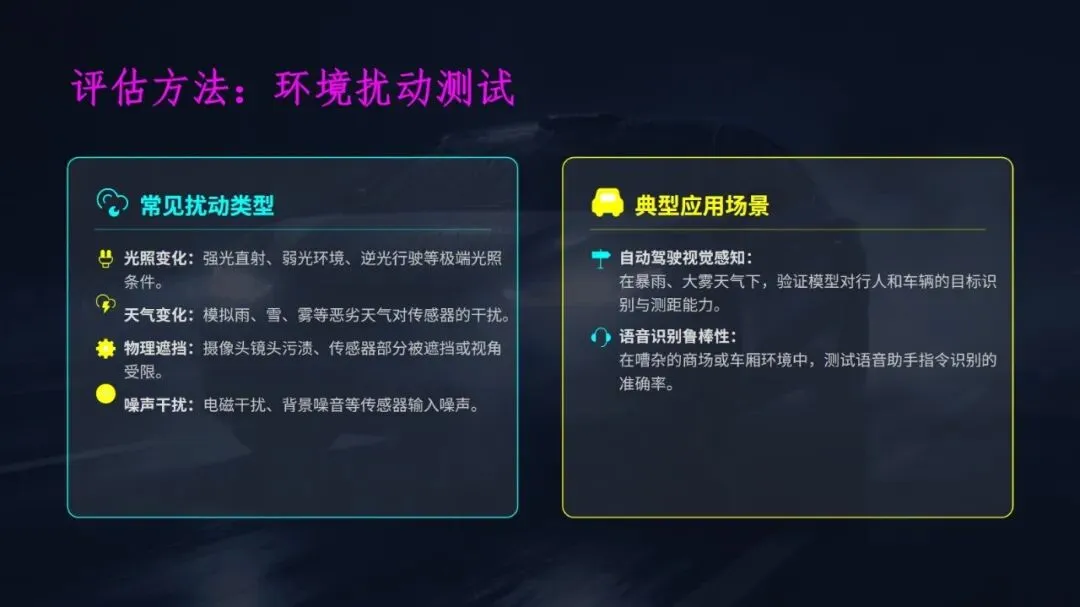

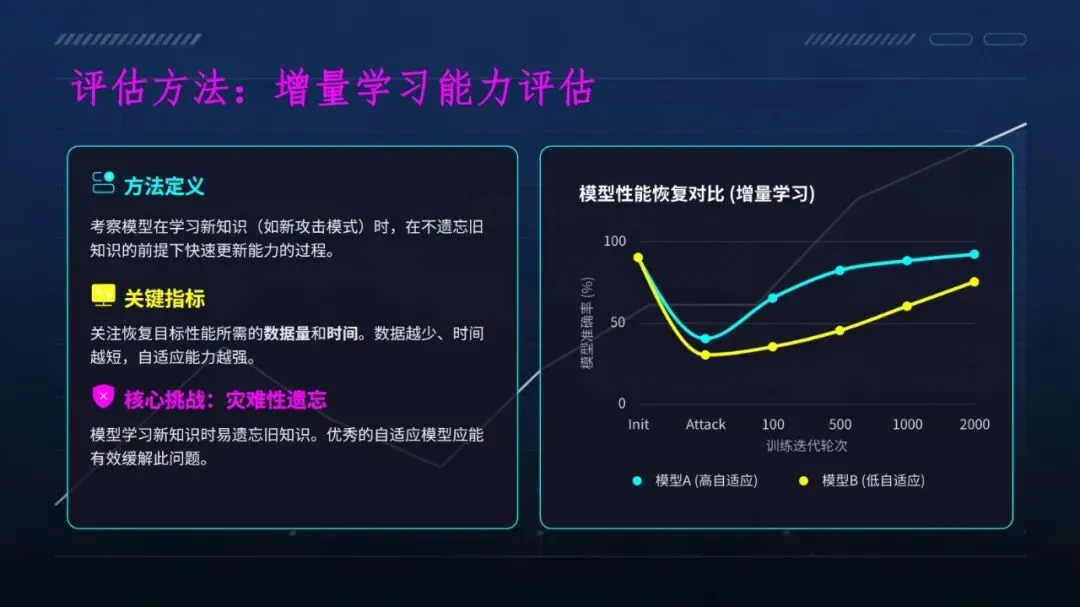

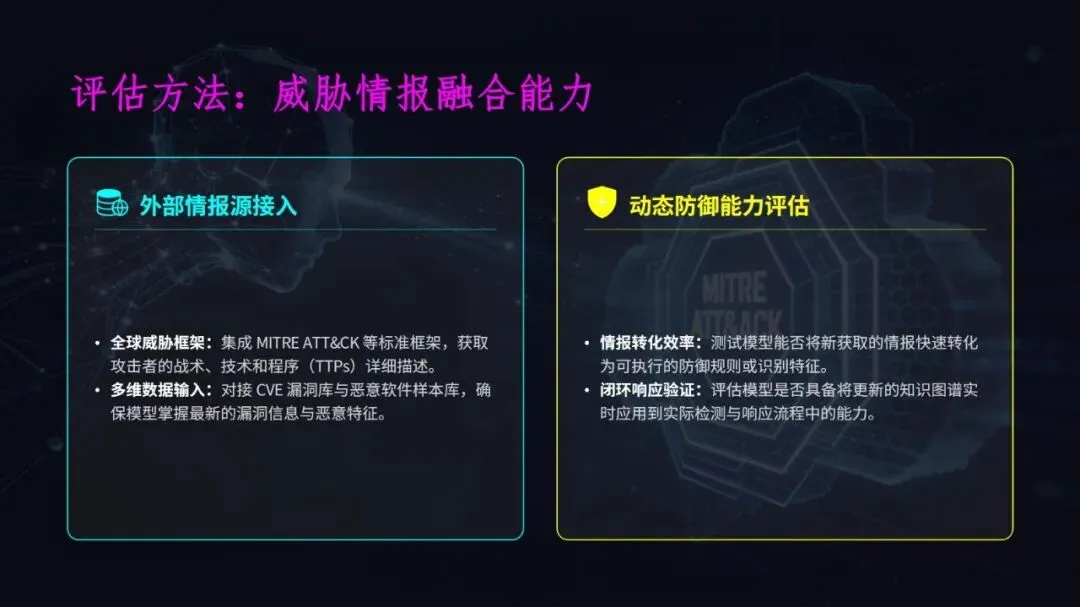

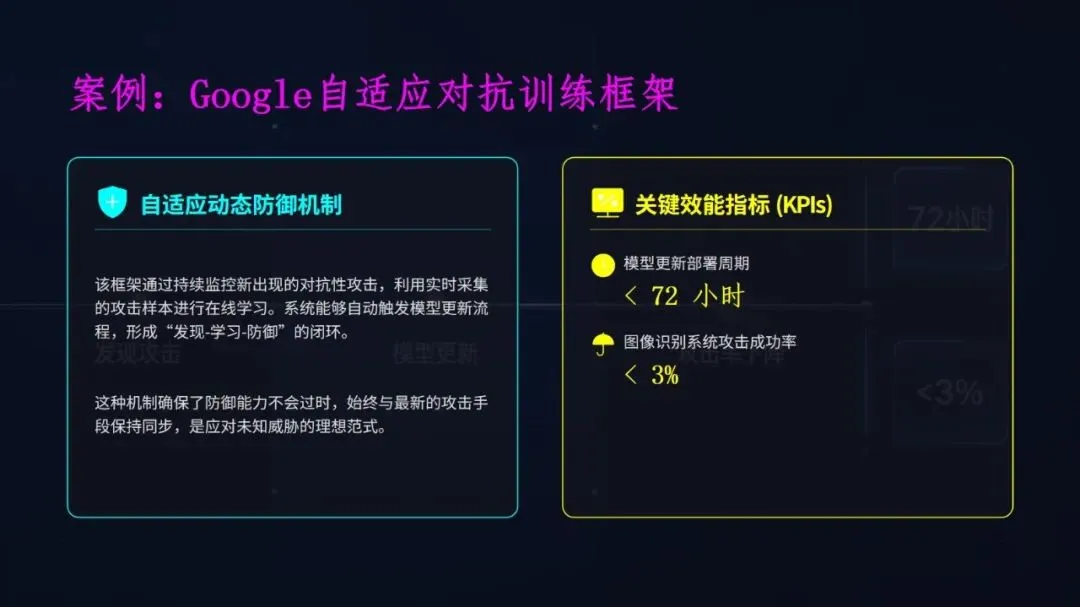

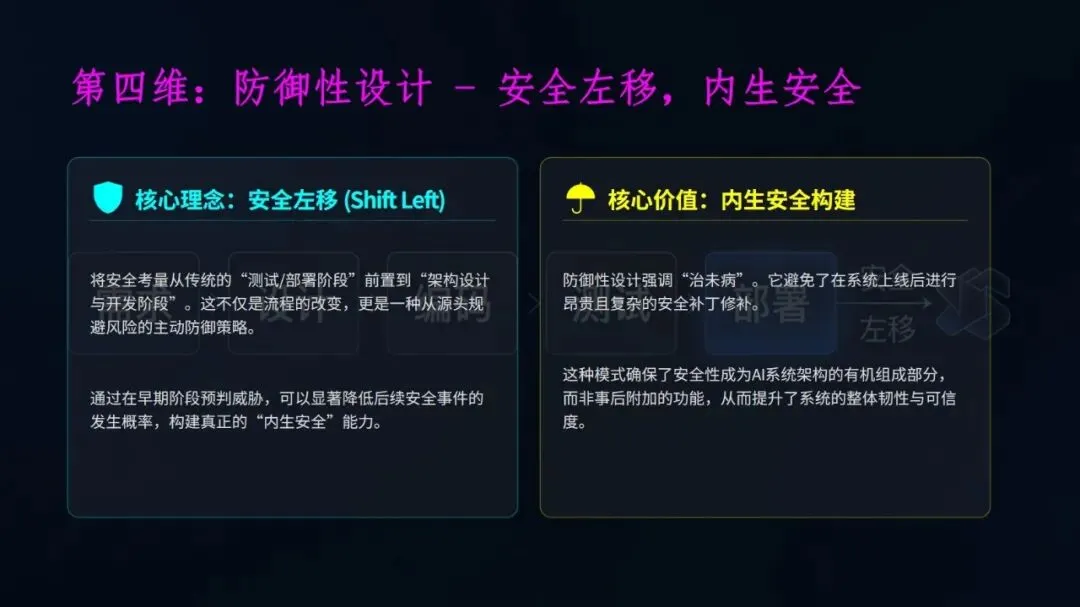

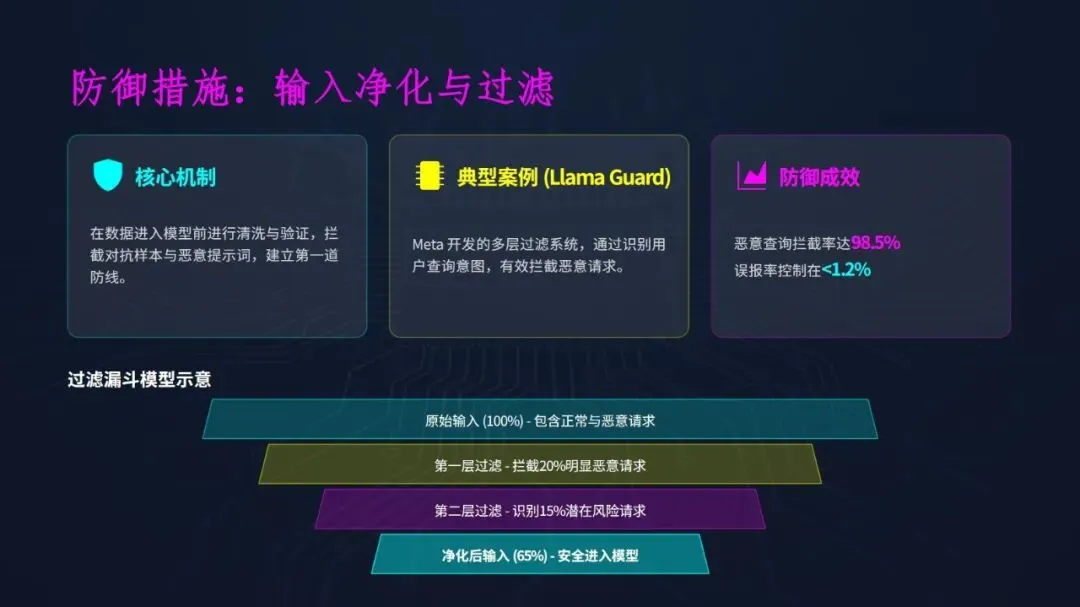

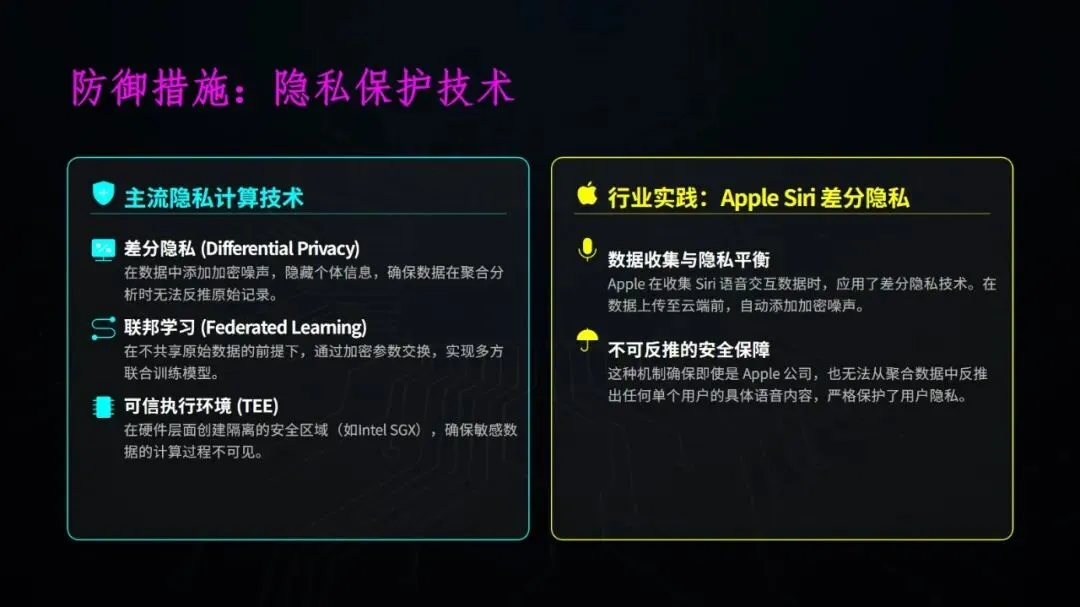

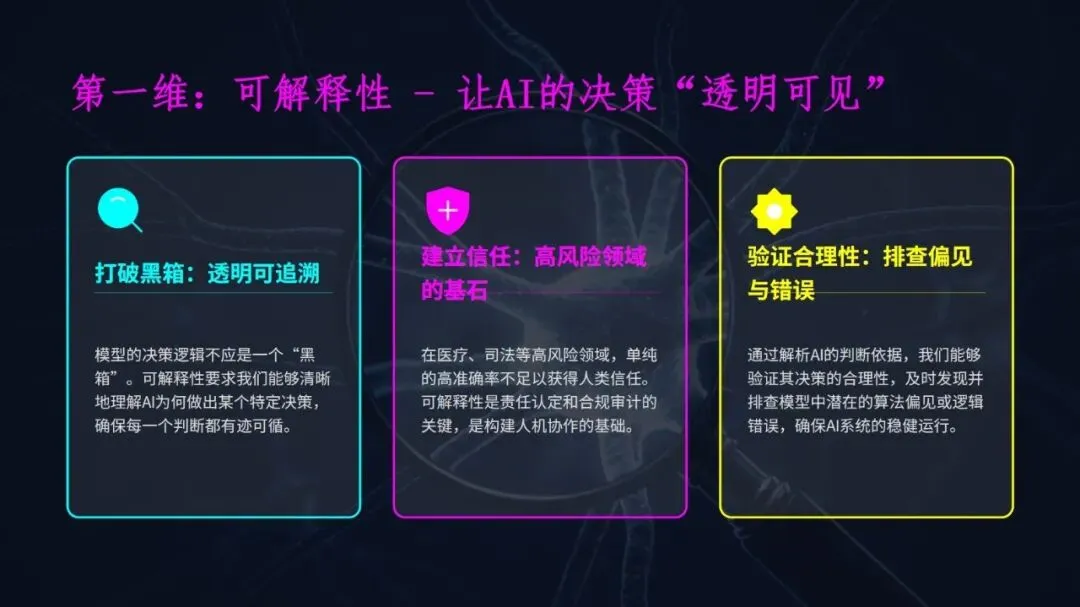

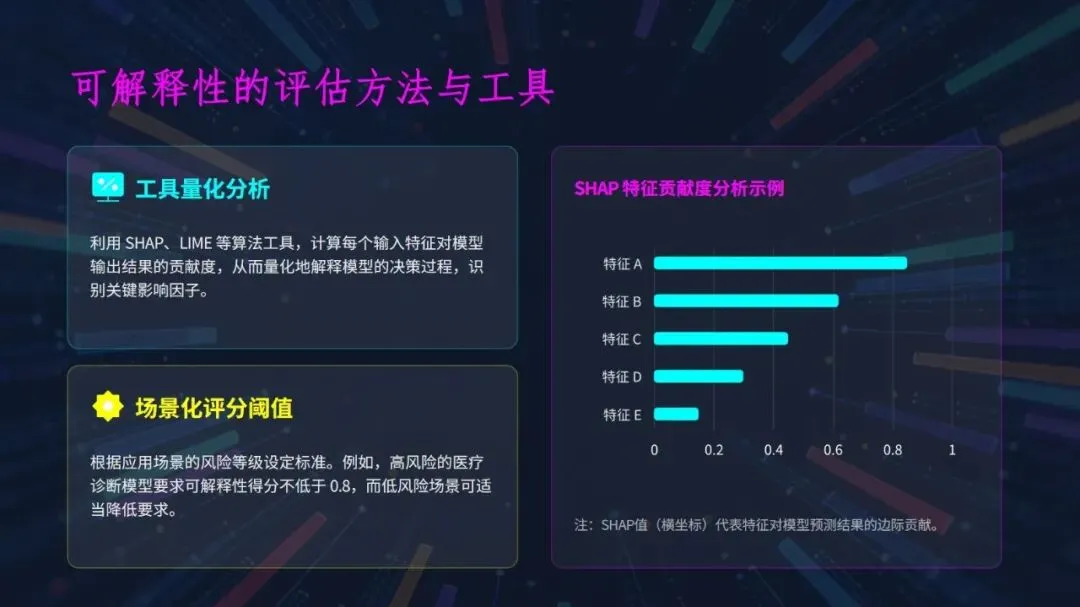

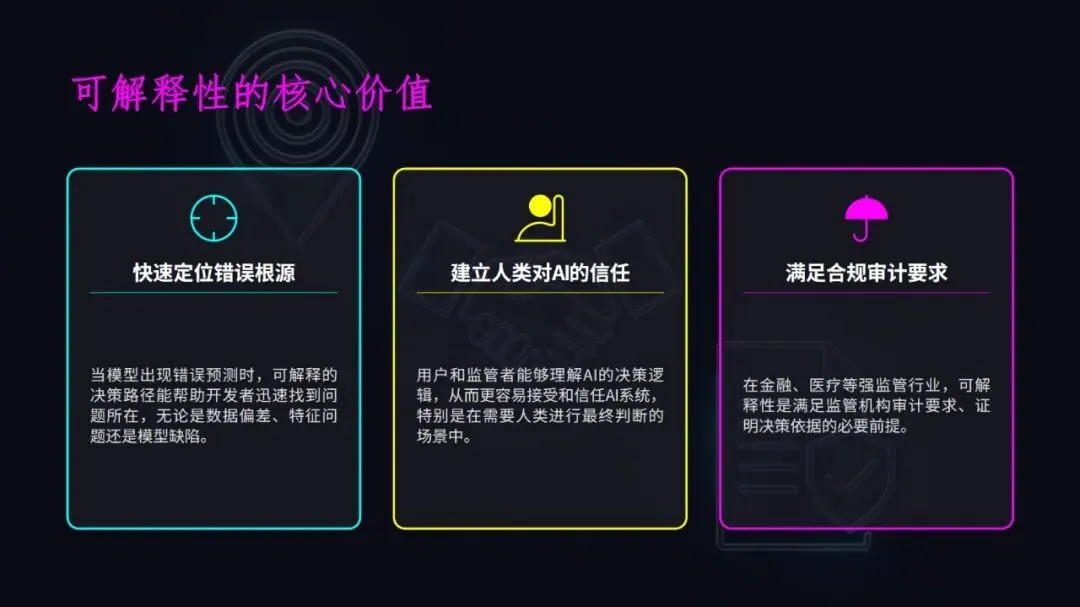

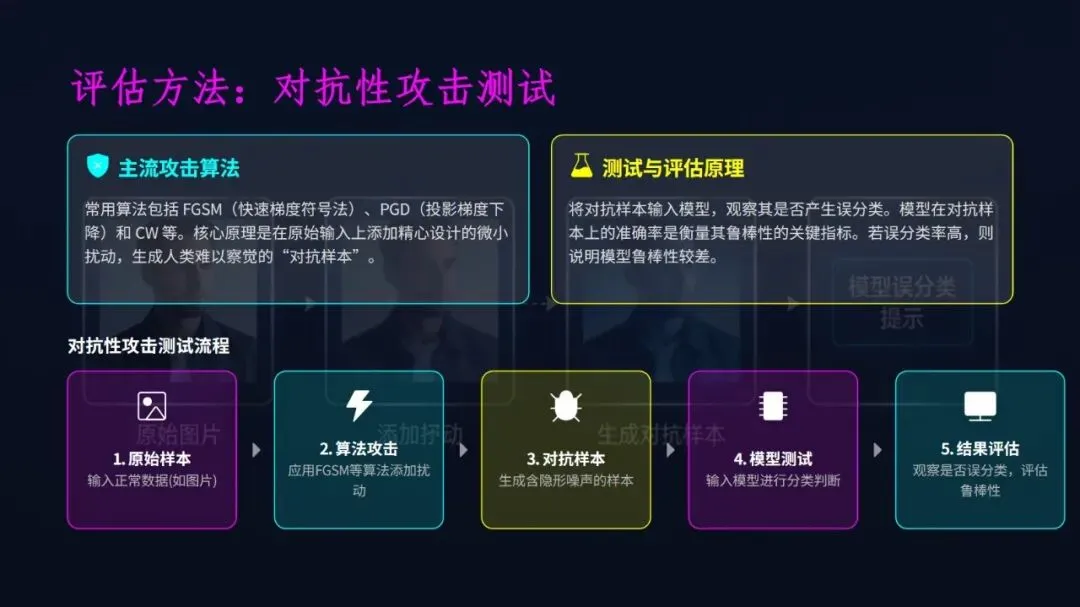

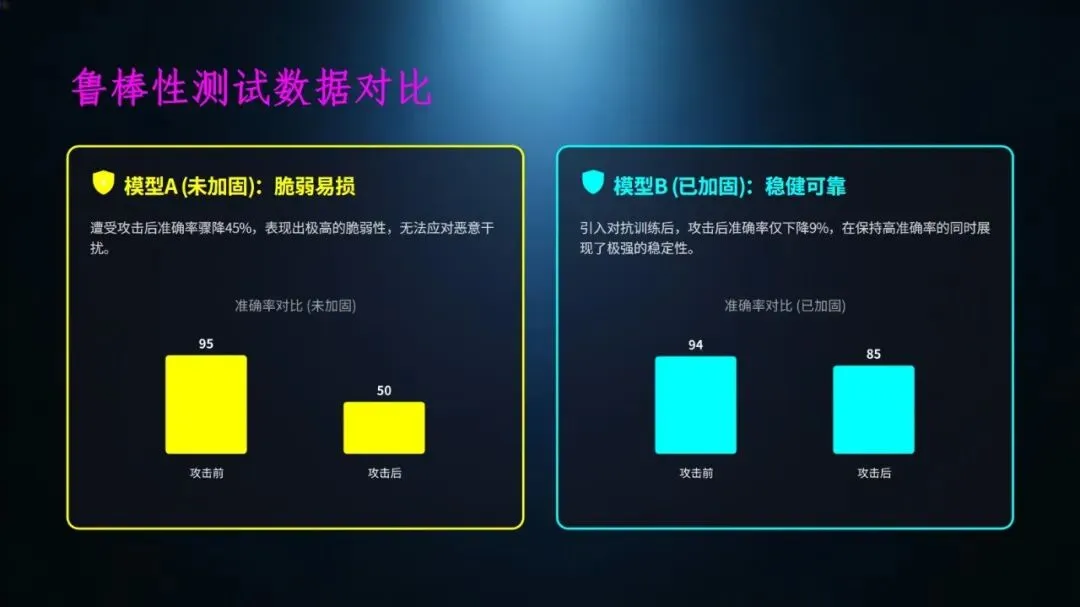

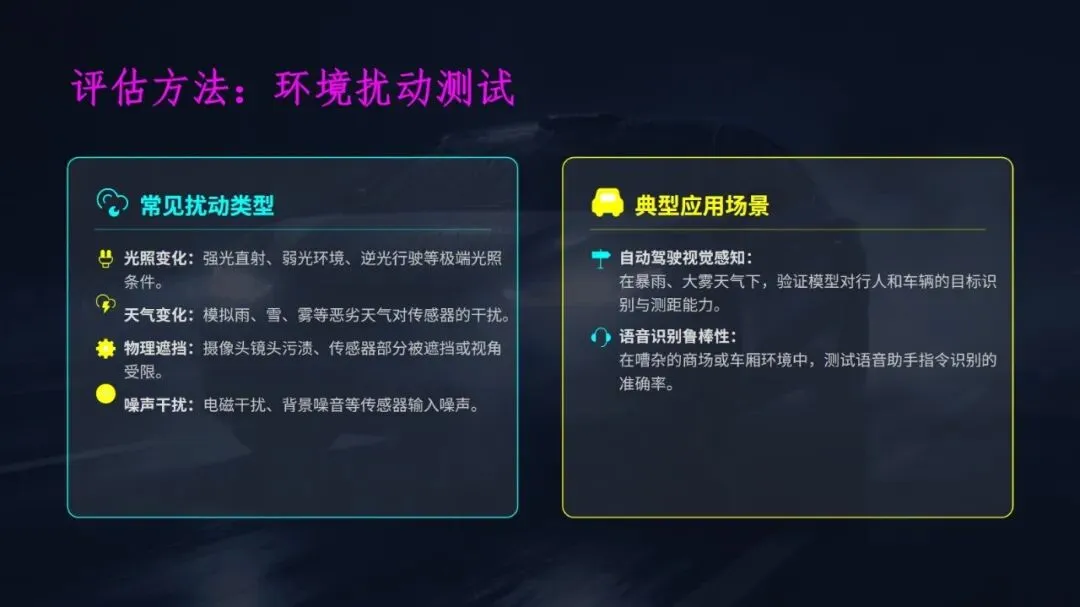

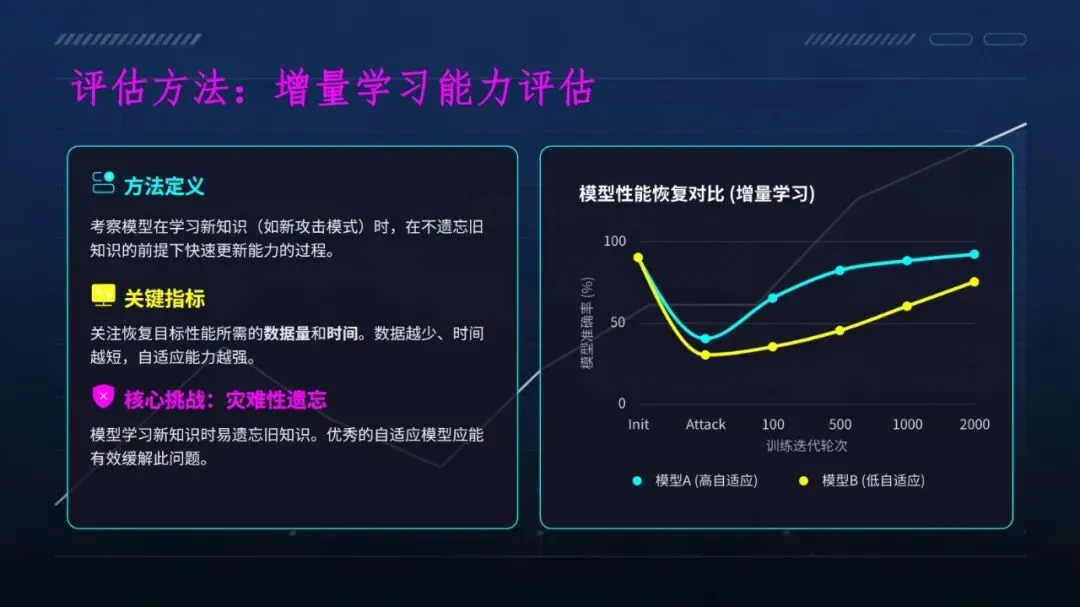

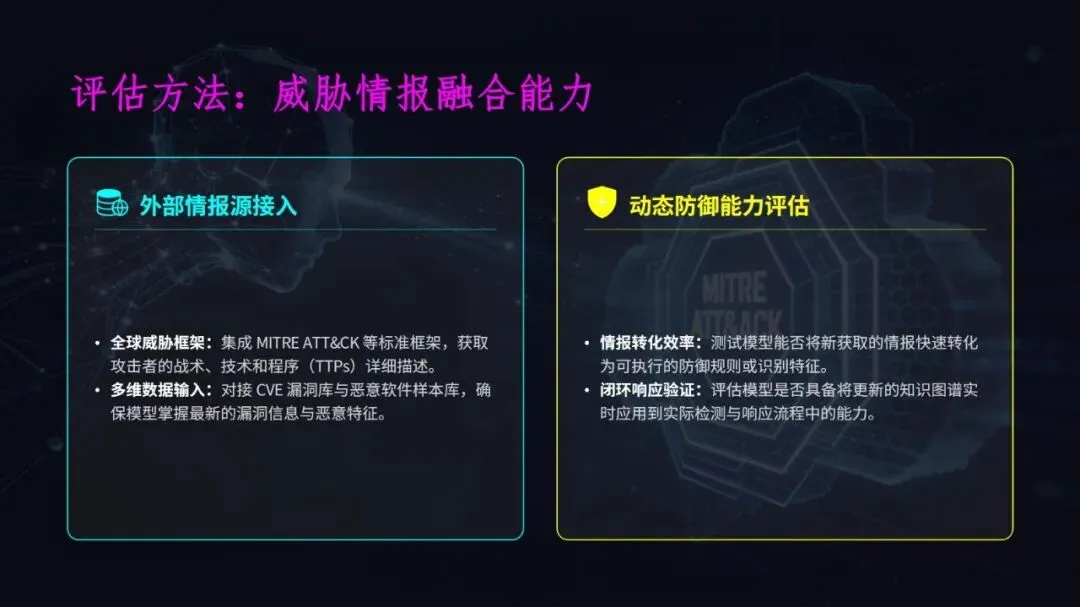

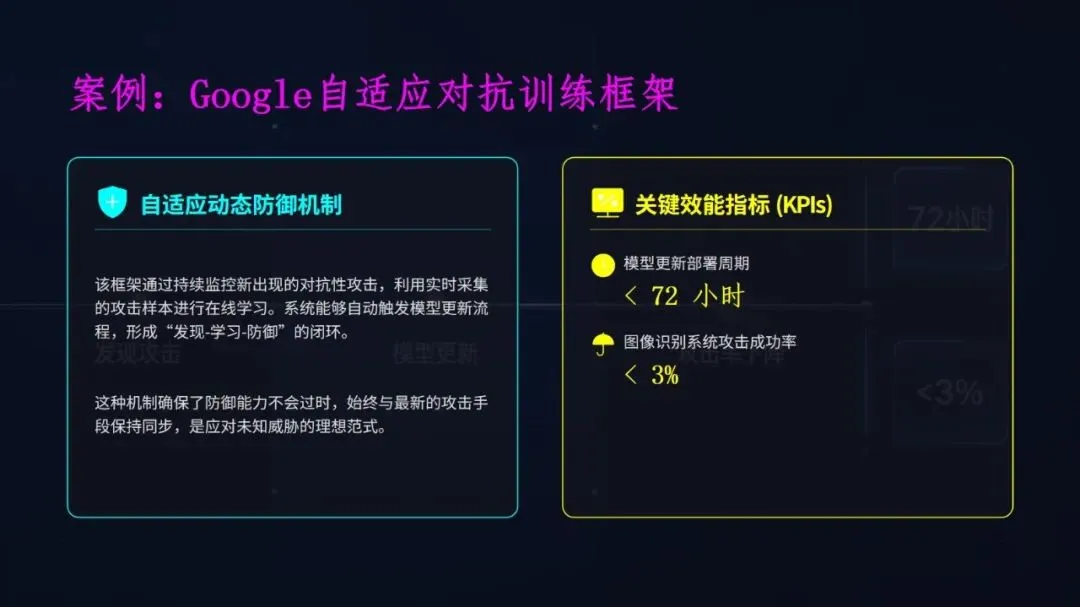

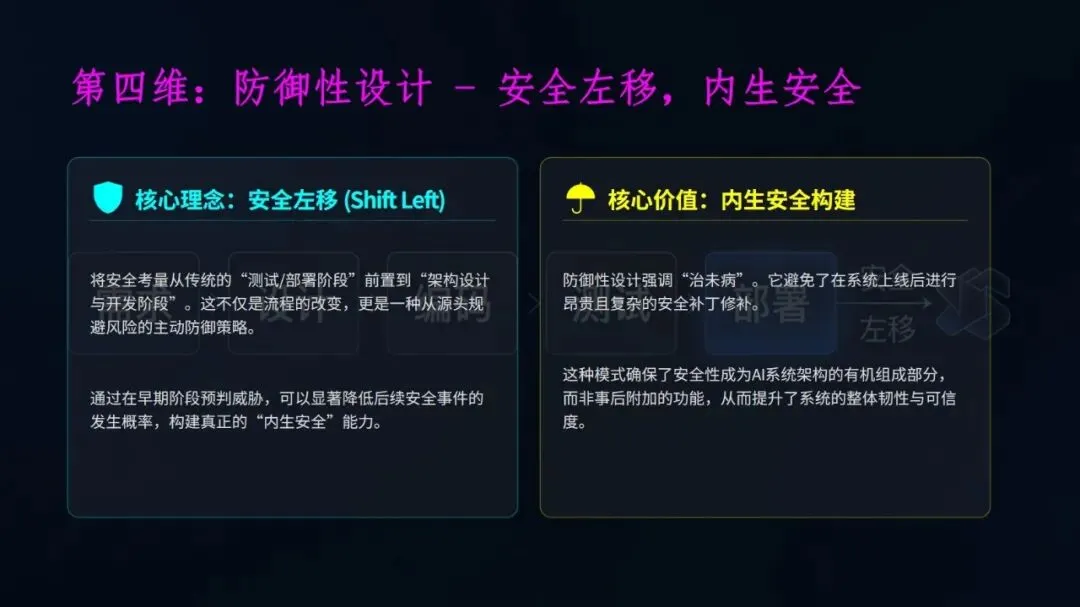

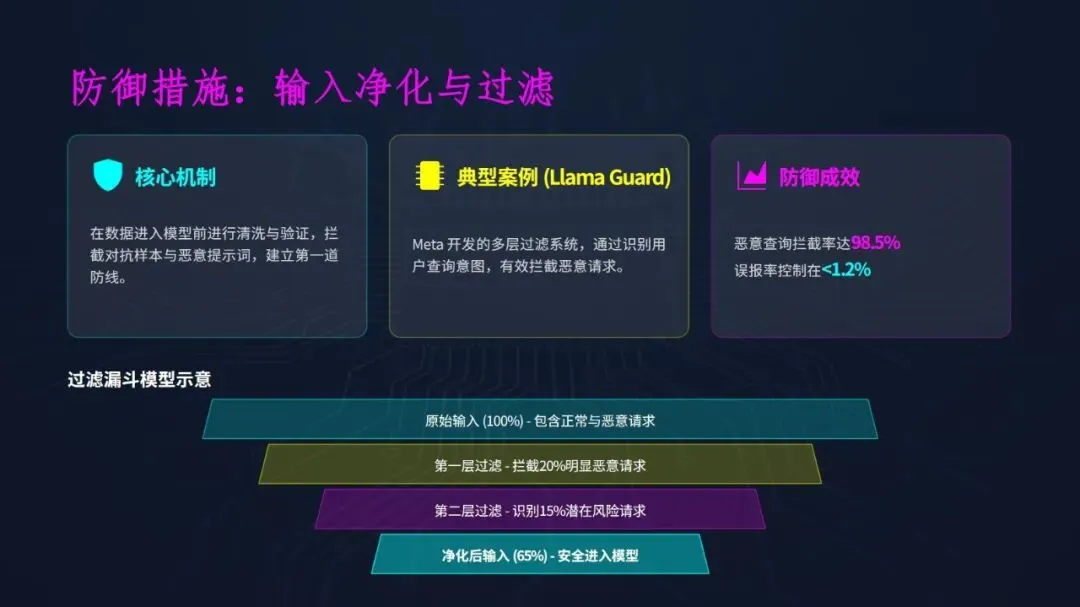

这套框架的核心是可解释性、鲁棒性、自适应能力、防御性设计四大维度。可解释性让模型决策逻辑透明可追溯,靠量化工具支撑,是合规审计的重要依据,还能帮助快速定位问题根源;鲁棒性通过对抗性测试和环境扰动测试,保障模型在恶意干扰或异常场景下性能稳定,就像模型的 “免疫系统”;自适应能力支持模型持续学习,能动态适配新型威胁,通过增量学习和融合外部安全知识库实现自我更新;防御性设计秉持 “安全左移” 理念,从输入净化、架构优化等方面增强系统内生安全。

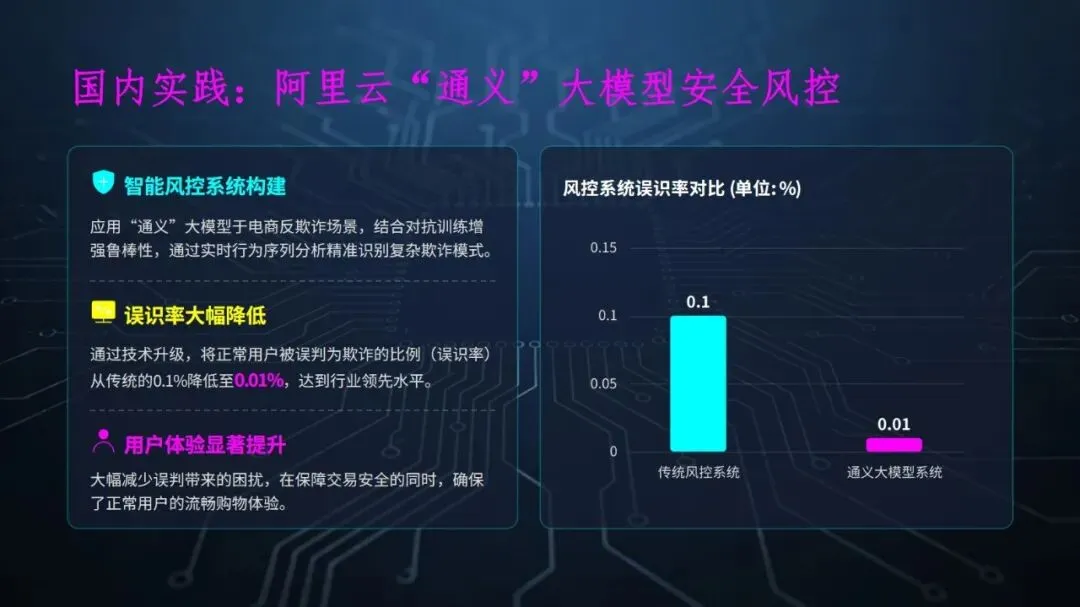

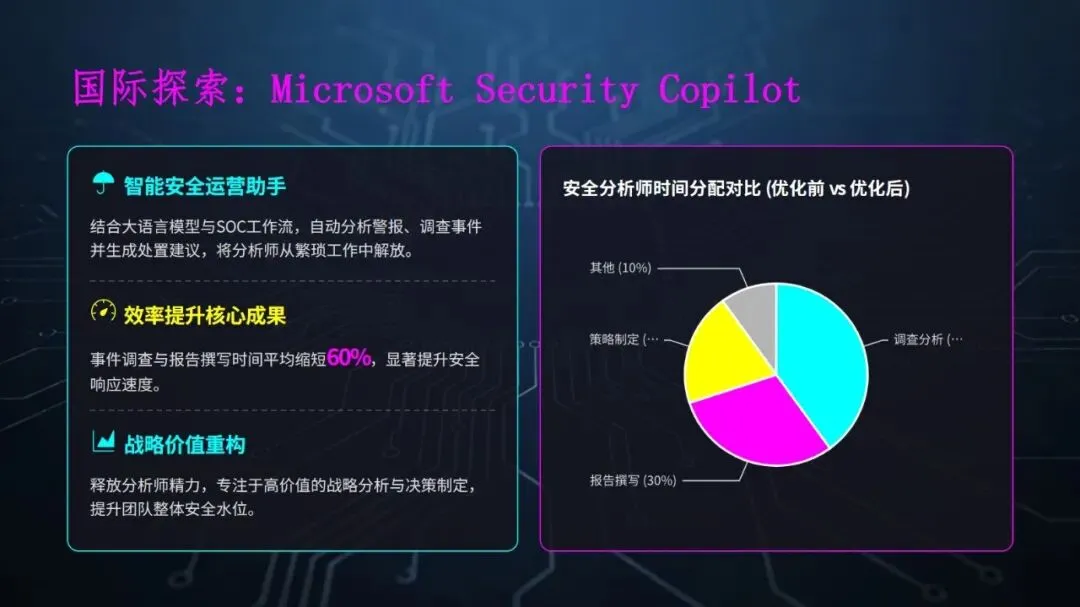

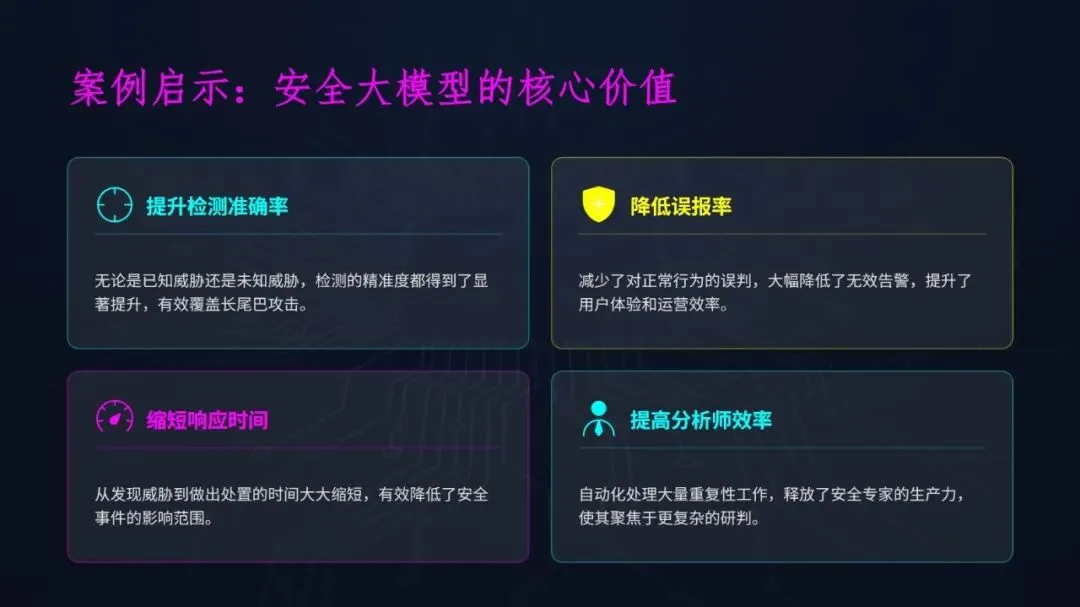

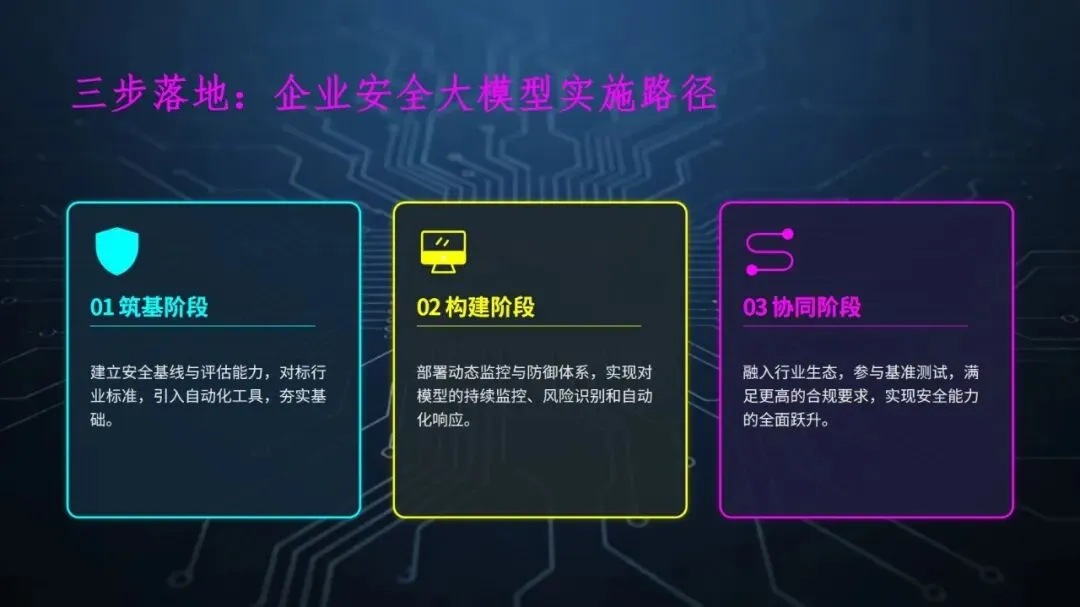

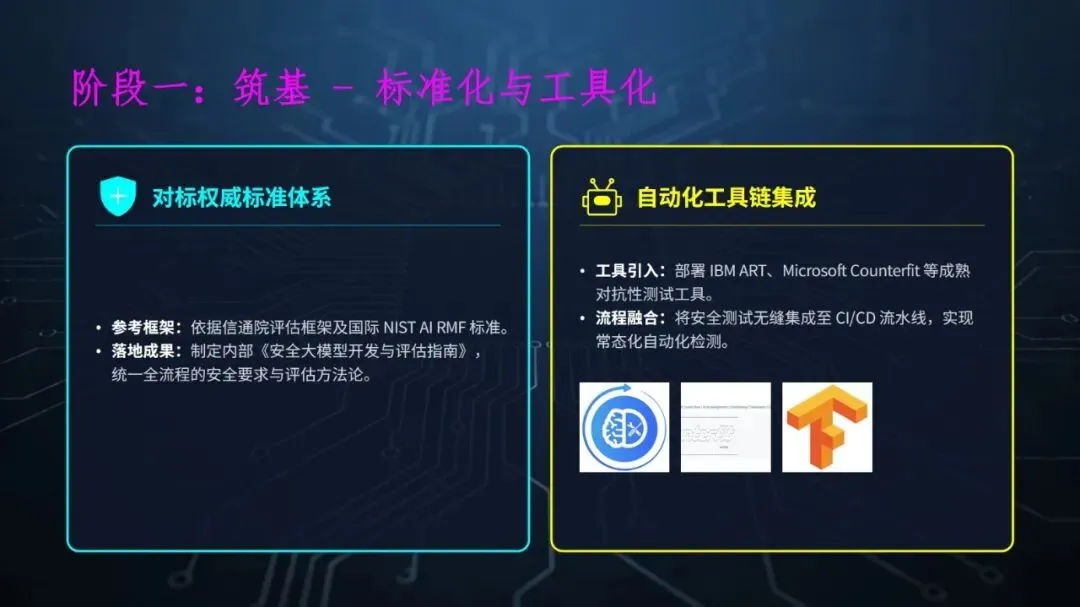

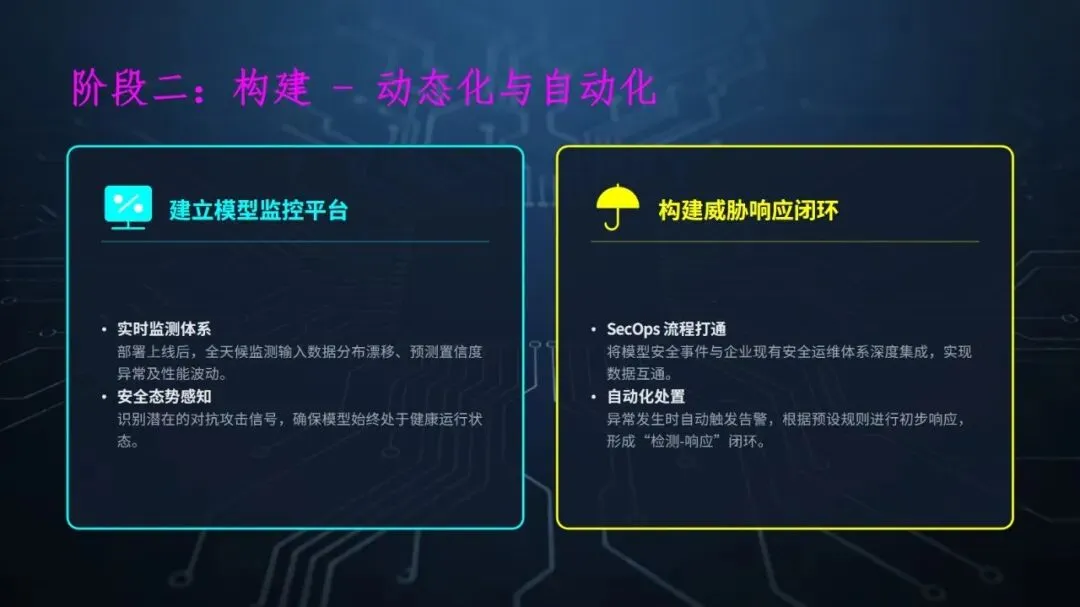

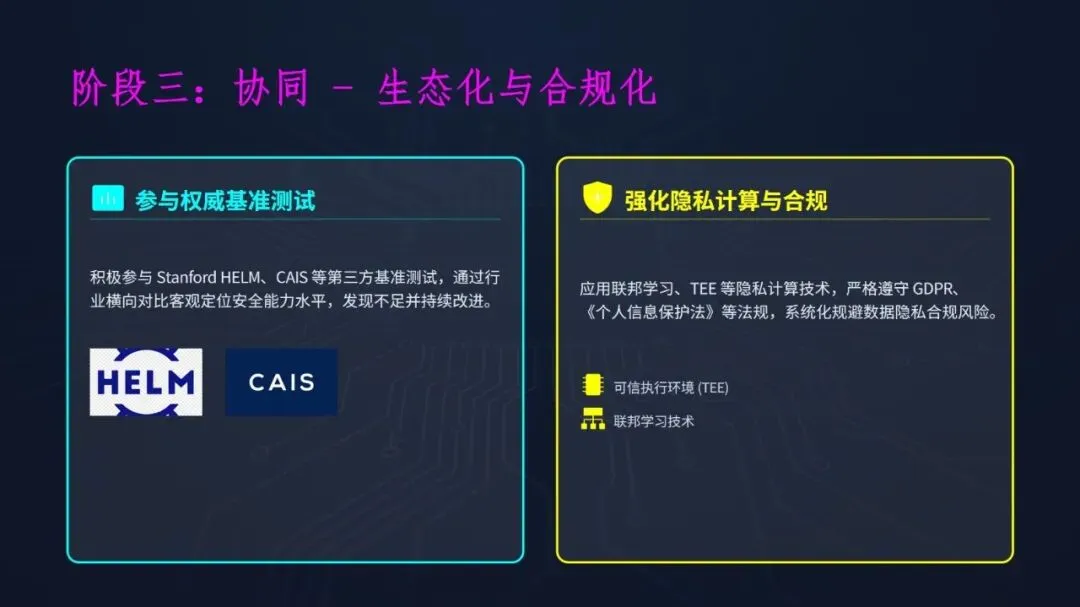

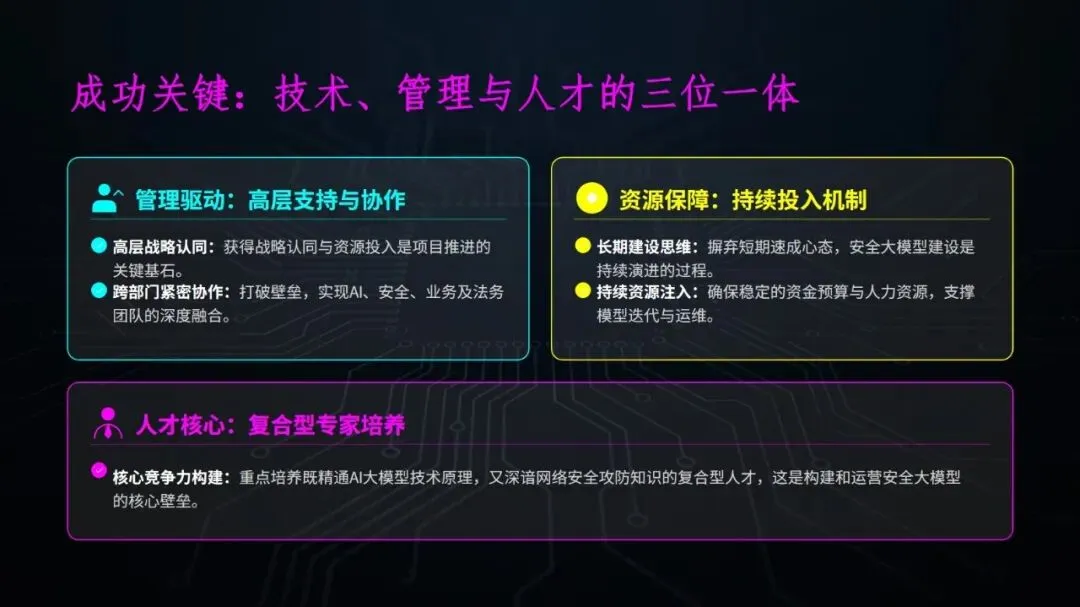

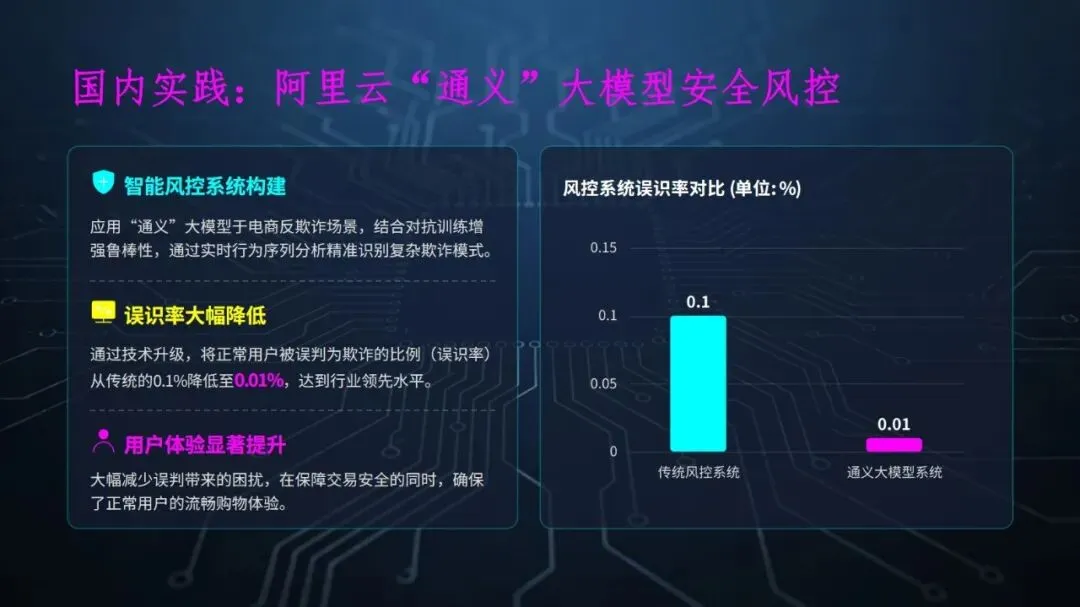

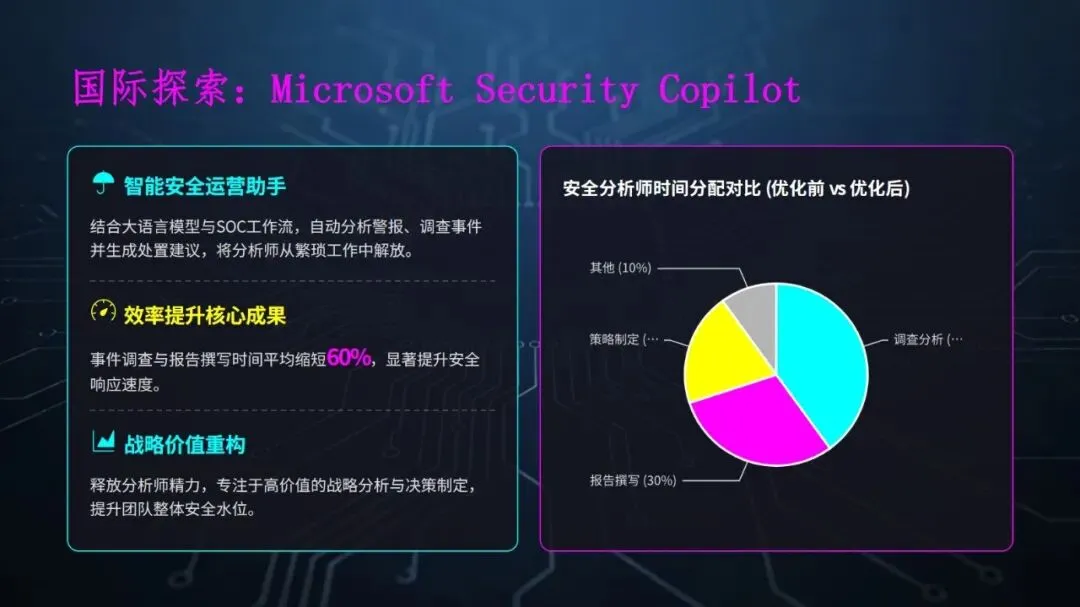

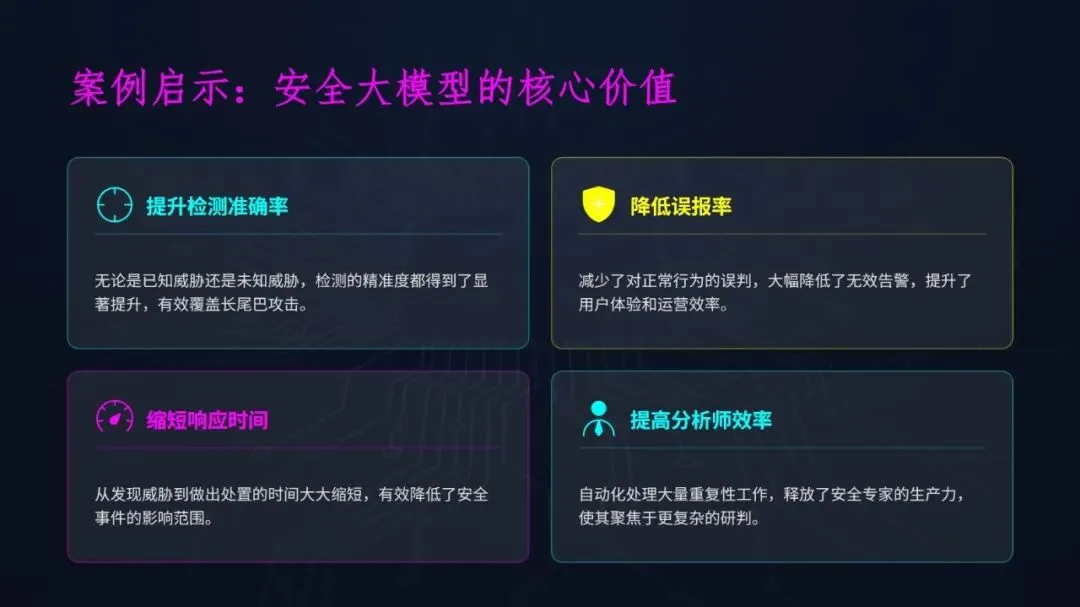

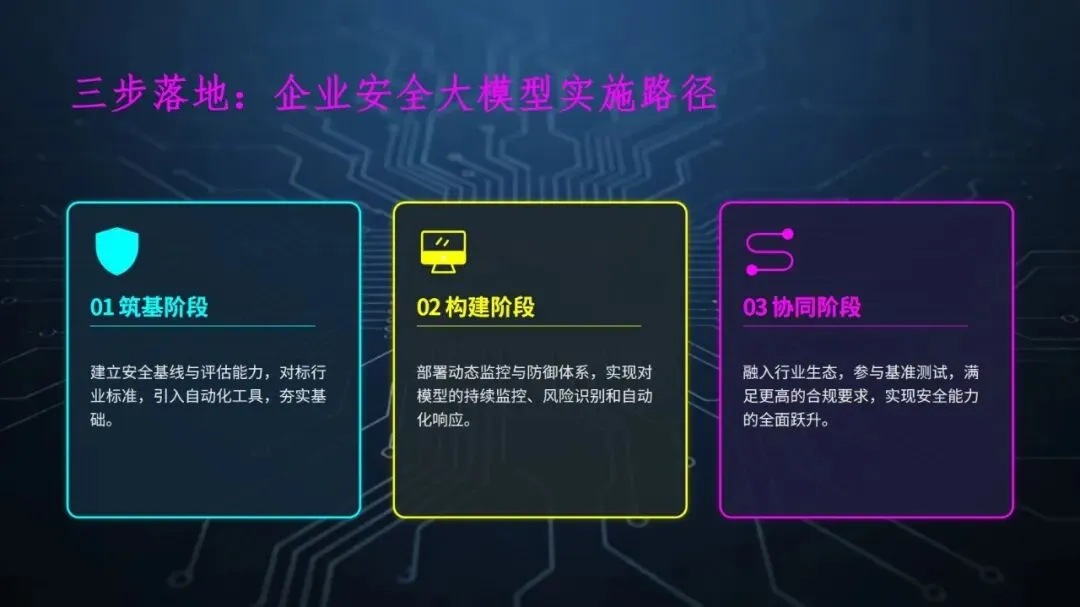

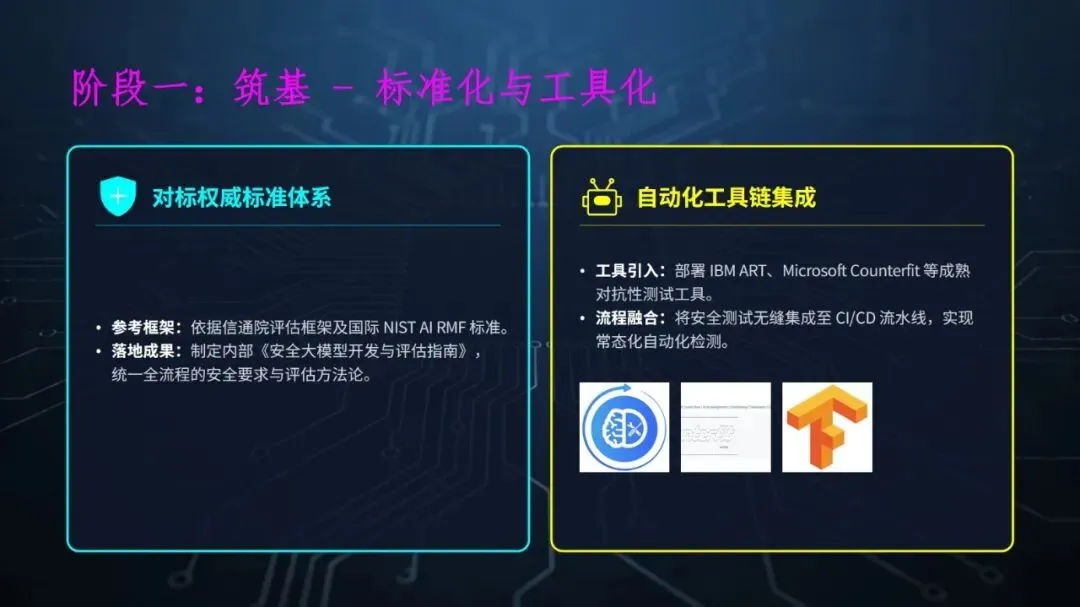

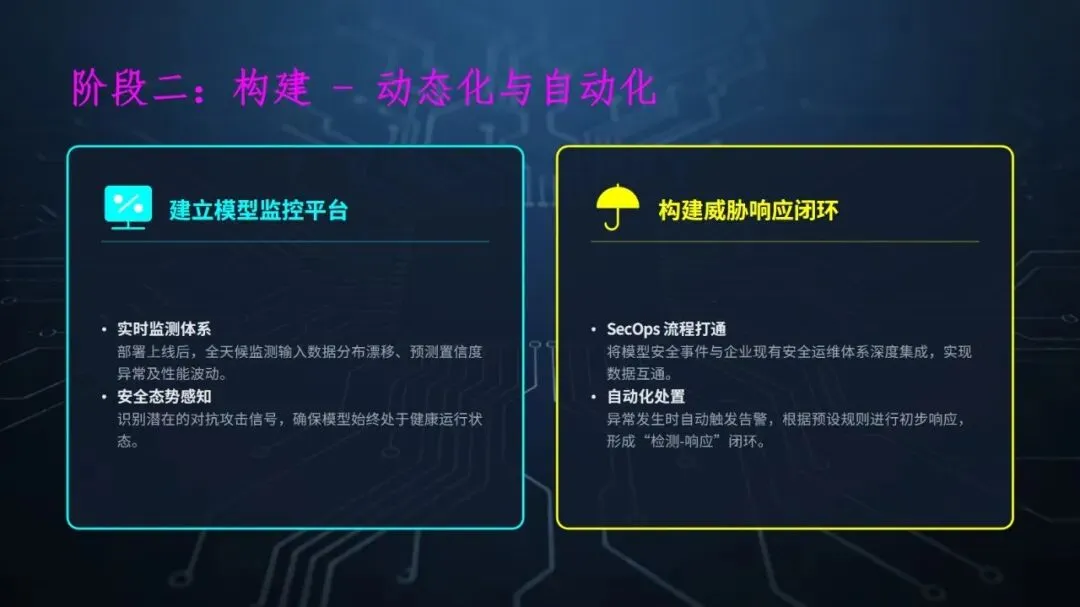

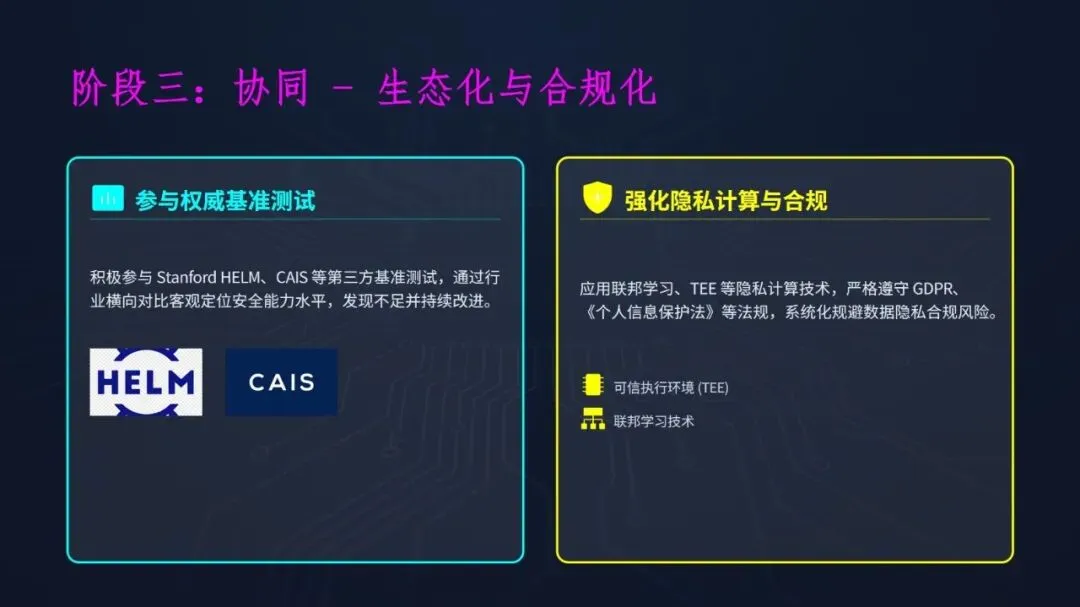

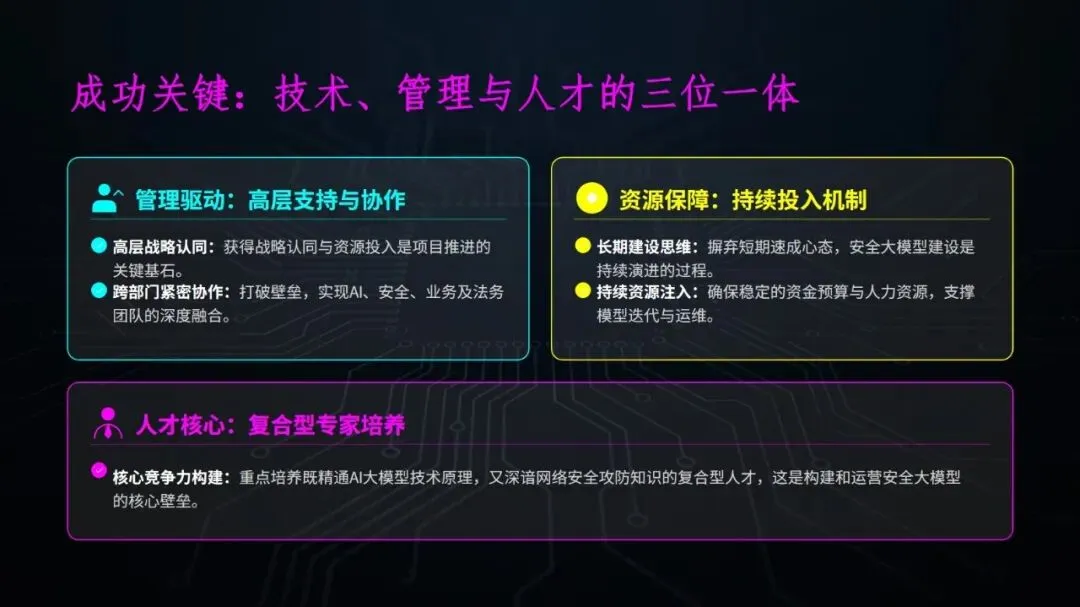

国内外实践已经印证了这套框架的实际价值:阿里云、华为等国内企业落地后,安全效能大幅提升;OpenAI 通过制度化 “红队测试”、微软将大模型与安全运营流程结合,都优化了安全防御效果。企业落地时可按 “筑基 - 构建 - 协同” 三步推进,先对标标准建立安全基线、引入测试工具,再搭建动态监控与防御体系,最后融入行业生态、满足合规要求。

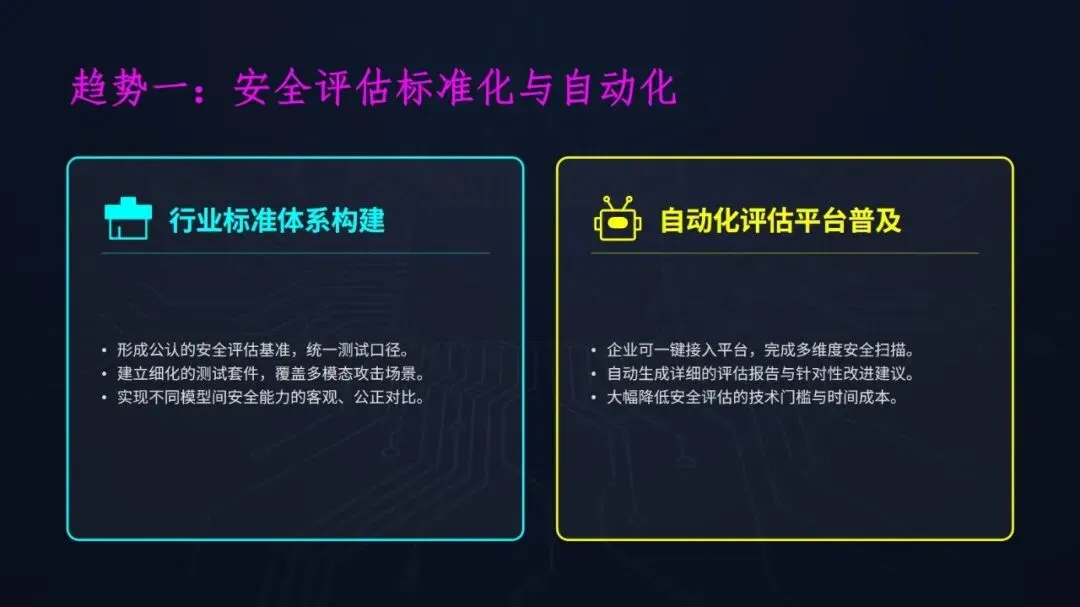

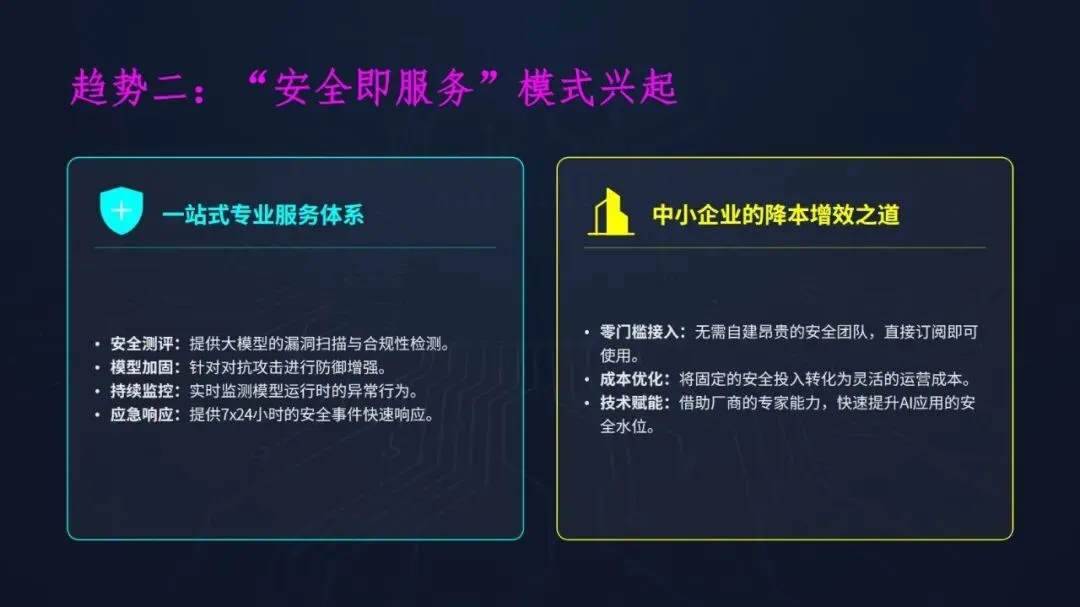

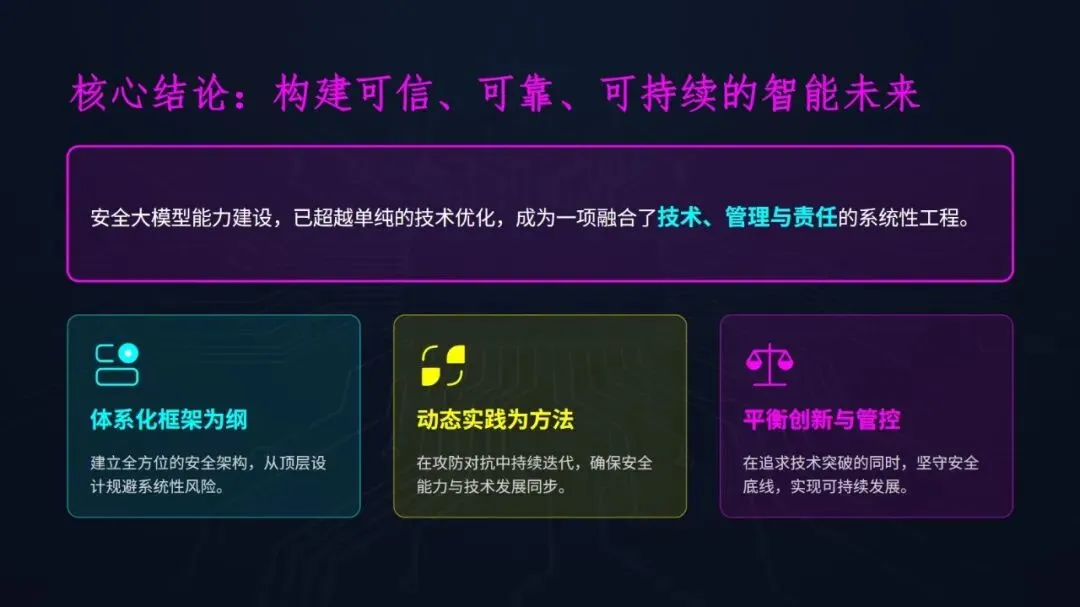

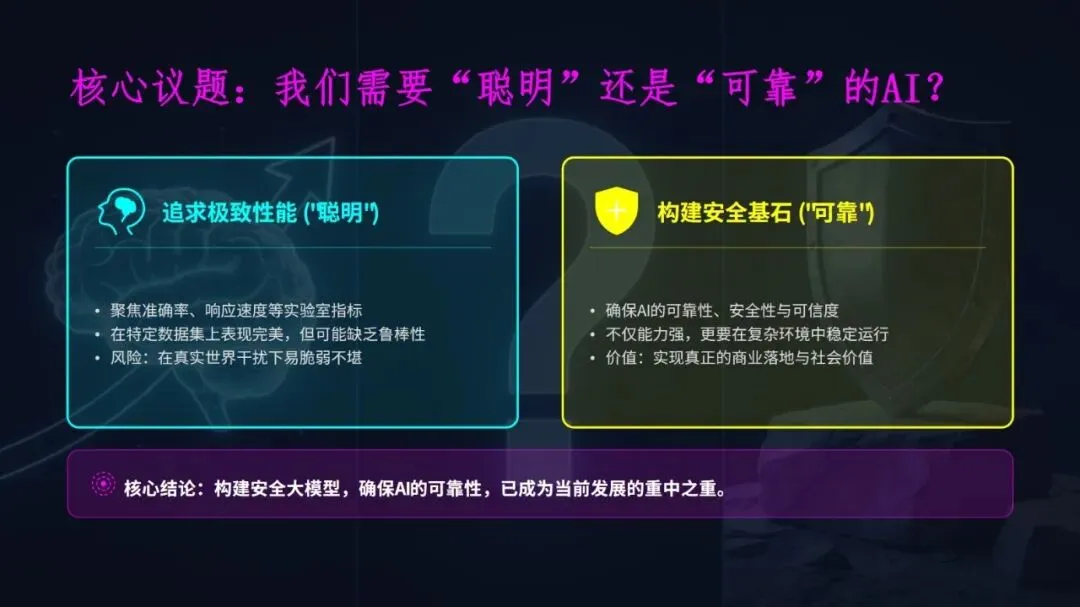

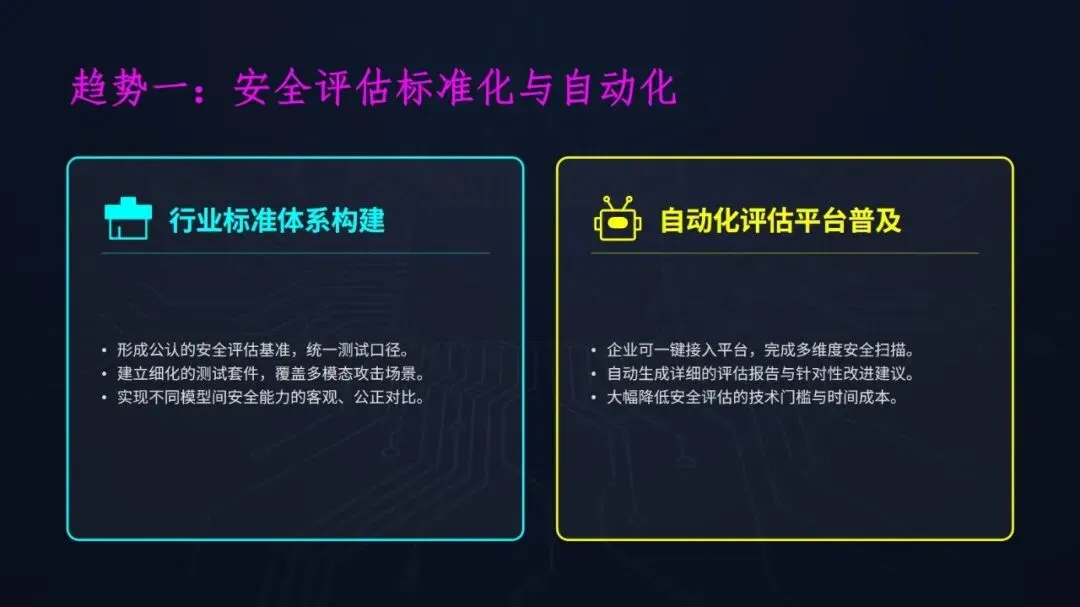

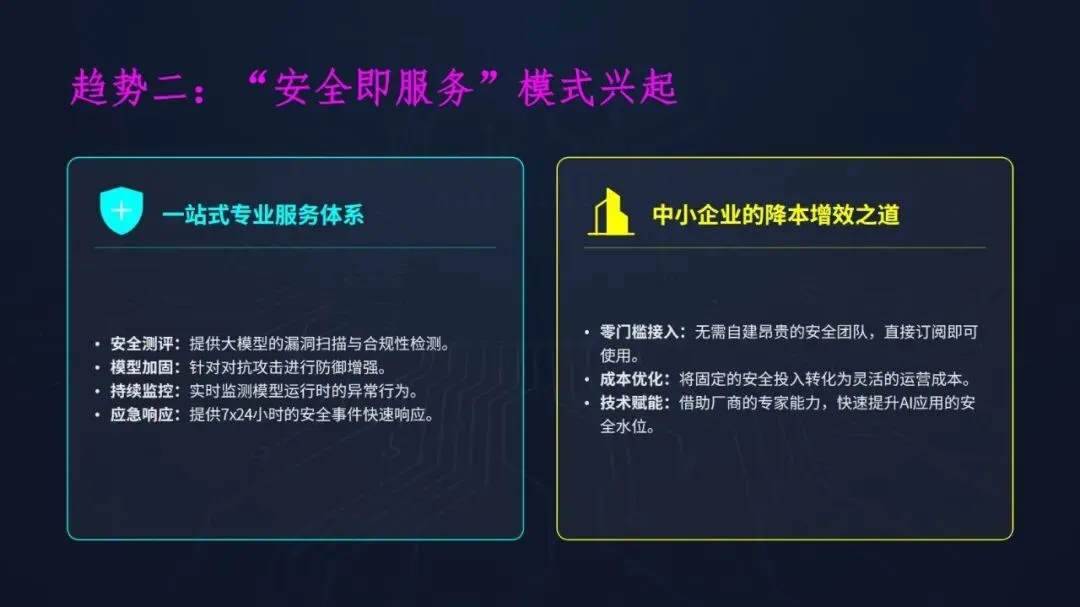

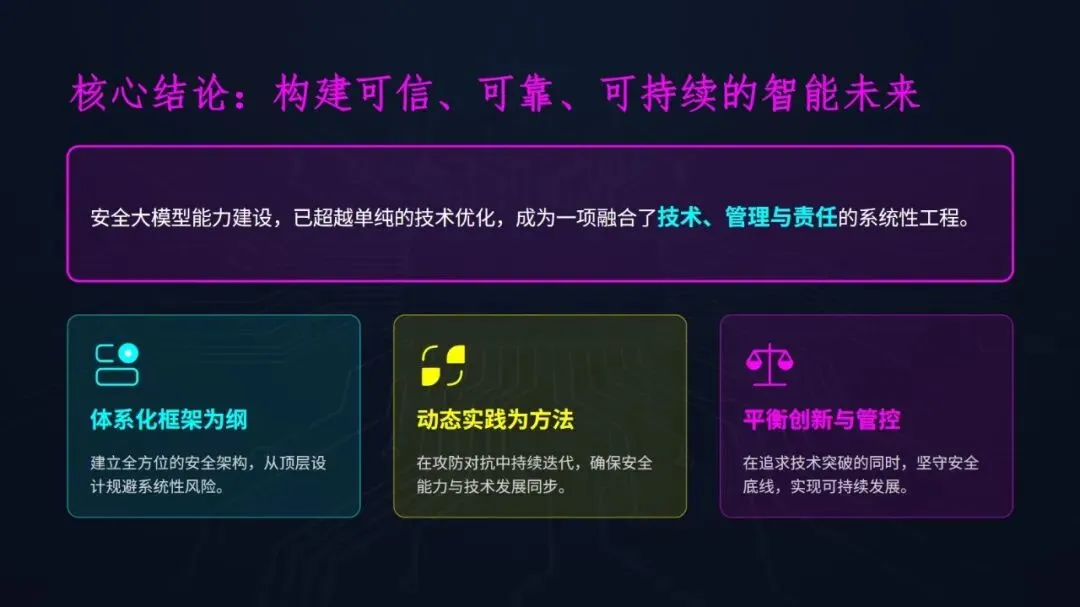

未来,安全大模型评估会朝着标准化、自动化方向发展,“安全即服务” 模式和可验证安全技术将成为重要趋势。安全大模型建设早已不只是单纯的技术优化,而是融合了技术、管理与责任的系统工程。只有在技术创新与风险管控之间找到平衡,才能构建出可信、可靠的人工智能生态。

点击阅读原文获取《企业落地安全大模型必看:评估框架 + 前沿实践双指南》

本文来自网友投稿或网络内容,如有侵犯您的权益请联系我们删除,联系邮箱:wyl860211@qq.com 。